A Palantir já vende seus sistemas de vigilância para o Departamento de Imigração e Alfândega dos Estados Unidos, então não é surpresa que esteja tentando promover suas soluções também no Pentágono. Em particular, ela apresentou um vídeo de demonstração do sistema Artificial Intelligence Platform (AIP). Embora o objetivo principal do sistema seja a integração de grandes modelos de linguagem como GPT-4 ou Google BERT em redes privadas, o primeiro exemplo demonstra a possibilidade de uso precisamente militar em condições de combate modernas.

Fonte da imagem: Palantir See More

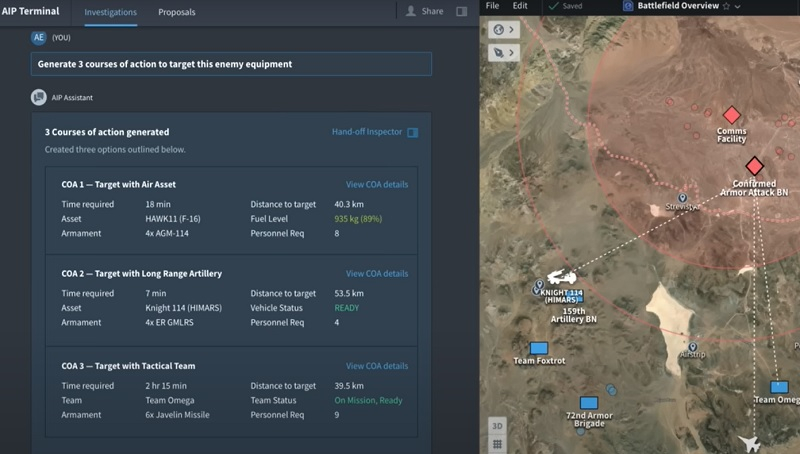

No vídeo de demonstração, o operador do sistema detecta as forças inimigas e pede ao assistente de IA que envie drones de reconhecimento, prepare opções para possíveis respostas táticas à ameaça e até mesmo organize o bloqueio de rádio das comunicações prioritárias. O AIP ajuda a avaliar as forças e capacidades inimigas com a ajuda do drone Reaper e sugere possíveis respostas, levando em consideração o número de armas leves antitanque disponíveis para cada unidade.

O vídeo enfatiza que grandes modelos e algoritmos de linguagem devem ser rigorosamente controlados para garantir que sejam usados de “maneira legal e ética”. Conforme relatado, o trabalho da AIP deve ser baseado em três disposições principais. Primeiro, a AIP deve ser aplicada “ética e legalmente” dentro de um sistema secreto capaz de coletar dados secretos e abertos. Em segundo lugar, cabe aos operadores determinar o que exatamente a IA pode e não pode ver e quais ações ela tem o direito de realizar. Em terceiro lugar, o AIP deve usar mecanismos restritivos avançados para impedir ações não autorizadas da IA.

É por isso que, segundo Palantir, uma pessoa deve atuar como um elo fundamental na cadeia de controle, embora no próprio vídeo de demonstração o operador simplesmente siga as recomendações da IA, escolhendo ações a partir de um conjunto de propostas.

É importante que o vídeo não especifique quais medidas estão sendo tomadas para evitar “alucinações” características de todos os grandes modelos modernos de linguagem – no caso de trabalho no campo de batalha, tais falhas podem levar a consequências catastróficas não apenas para o inimigo , mas também para os próprios operadores do sistema.