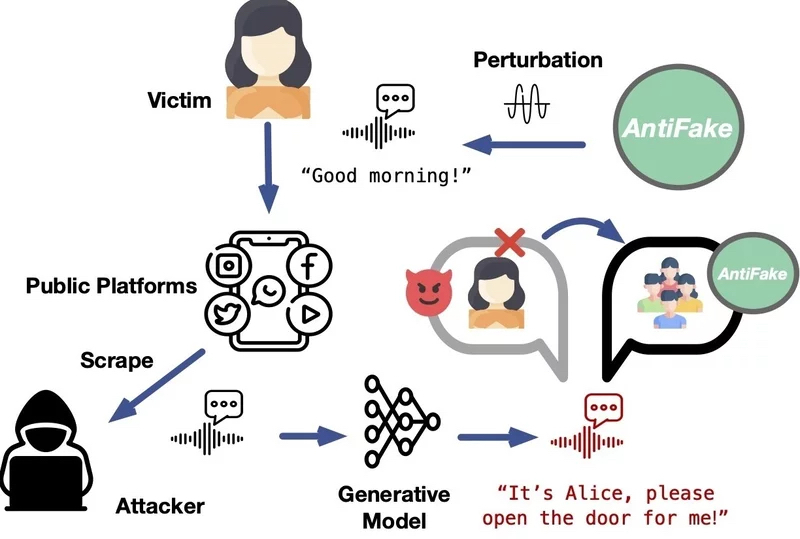

As tecnologias de falsificação de voz usando inteligência artificial são uma ferramenta bastante perigosa – elas são capazes de reproduzir uma voz humana de maneira confiável, mesmo a partir de uma amostra curta. O algoritmo AntiFake proposto por um cientista americano pode impedir a criação de uma falsificação habilidosa.

Fonte da imagem: Gerd Altmann / pixabay.com

Deepfakes são um fenômeno bastante perigoso – eles podem ser usados para atribuir a um artista ou político famoso uma declaração que ele nunca fez. Também houve precedentes em que o agressor ligou para a vítima e, na voz de um amigo, pediu a transferência urgente de dinheiro devido a alguma situação de emergência. Ning Zhang, professor assistente de ciência da computação e engenharia na Universidade de Washington em St. Louis, propôs uma tecnologia que torna muito mais difícil a criação de deepfakes de voz.

O princípio de operação do algoritmo AntiFake é criar condições sob as quais se torne muito mais difícil para o sistema de IA ler as principais características da voz ao gravar uma conversa de uma pessoa real. “A ferramenta usa uma técnica adversária de IA que foi originalmente usada por cibercriminosos, mas agora a voltamos contra eles. Distorcemos levemente o sinal de áudio gravado, criando perturbações apenas o suficiente para que para uma pessoa soe igual, mas para uma IA soe completamente diferente”, comentou o Sr. Zhang sobre seu projeto.

Fonte da imagem: wustl.edu

Isso significa que se você tentar criar um deepfake baseado em uma gravação modificada dessa forma, a voz gerada pela IA não será semelhante à voz da pessoa na amostra. Os testes mostraram que o algoritmo AntiFake é 95% eficaz na prevenção da síntese de deepfakes convincentes. “Não sei o que acontecerá a seguir com as tecnologias de IA de voz – novas ferramentas e funções estão em constante desenvolvimento – mas ainda acredito que a nossa estratégia de usar a tecnologia do inimigo contra si mesmo permanecerá eficaz”, concluiu o autor do projeto.