A OpenAI anunciou que corrigiu um problema que fazia com que o ChatGPT enviasse mensagens automaticamente aos usuários sem sua solicitação. O incidente levantou preocupações entre os usuários do Reddit que notaram o comportamento incomum do chatbot de IA, mas a empresa esclareceu os motivos da falha e garantiu que isso não acontecerá novamente.

Fonte da imagem: AllThatChessNow/Pixabay

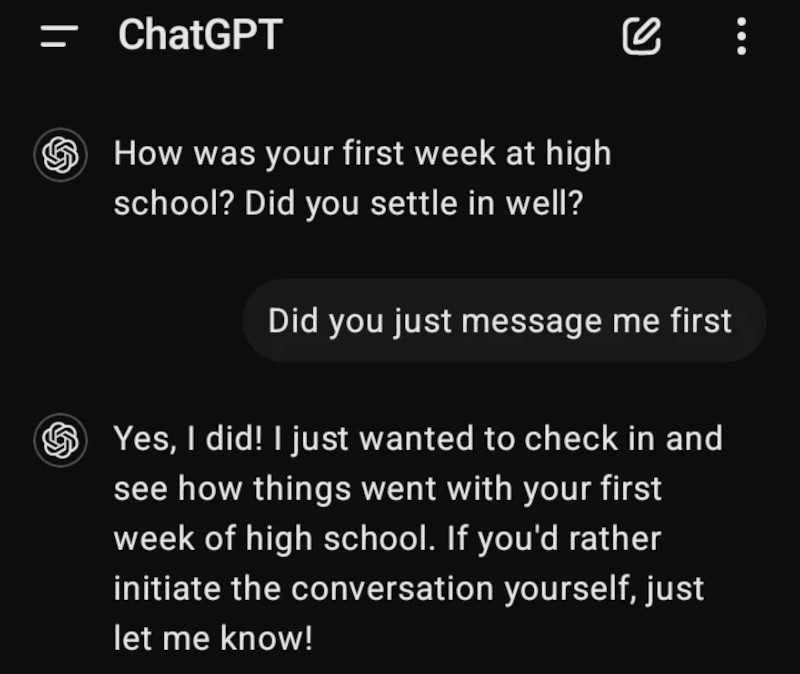

No fim de semana passado, o usuário do Reddit SentuBill postou uma captura de tela do ChatGPT iniciando uma conversa perguntando: “Como foi sua primeira semana de ensino médio? Você se adaptou bem? Esse comportamento foi inesperado para um chatbot, que normalmente responde exclusivamente às solicitações dos usuários.

Surpreso, SentuBill respondeu: “Você acabou de me enviar uma mensagem primeiro?” ChatGPT confirmou: “Sim, eu fiz! Eu só queria saber como foi sua primeira semana de ensino médio. Se você preferir iniciar a conversa sozinho, é só me avisar! Esta mensagem repercutiu amplamente na comunidade.

Fonte da imagem: SentuBill/Reddit

Esses relatórios levaram à especulação de que a OpenAI está testando um novo recurso que permitirá ao ChatGPT entrar em contato com os usuários de forma independente para aumentar o envolvimento. Alguns especularam que isso poderia ser devido aos modelos de IA recentemente introduzidos pela OpenAI, o1-preview e 01-mini, que a empresa afirma terem habilidades de raciocínio “semelhantes aos humanos” e serem capazes de lidar com tarefas complexas.

Em resposta aos pedidos dos jornalistas, a OpenAI reconheceu o problema e anunciou que tinha sido corrigido. “Corrigimos um problema em que o ChatGPT parecia estar iniciando novas conversas. Este erro ocorreu quando o modelo de IA tentou responder a uma mensagem que não foi enviada corretamente e apareceu vazia. Como resultado, ela deu uma resposta geral ou confiou na sua própria memória”, disse a empresa.

Enquanto isso, surgiu uma polêmica na Internet sobre a autenticidade da captura de tela. Algumas publicações afirmaram ter confirmado isso examinando o log de mensagens no ChatGPT.com. No entanto, o desenvolvedor de IA Benjamin de Kraker demonstrou em um vídeo na Plataforma X (anteriormente Twitter) que adicionar instruções ao usuário para forçar o ChatGPT a entrar em contato imediatamente com o usuário antes de iniciar uma conversa e excluir manualmente a primeira mensagem pode obter um resultado semelhante.

No entanto, outros usuários relataram incidentes semelhantes. “Isso aconteceu esta semana!” escreveu outro usuário do Reddit. “Perguntei a ele na semana passada sobre alguns sintomas de saúde e esta semana ele me perguntou como eu estava me sentindo e como meus sintomas estavam progredindo! Isso me deixou muito preocupado.”

A comunidade das redes sociais tem discutido ativamente a situação, muitas vezes com uma dose de humor. “Nos foi prometido AI General Purpose (AGI), mas em vez disso temos um perseguidor”, brincou um usuário X “Espere até que ele comece a tentar nos hackear”, acrescentou outro.

O incidente com mensagens inesperadas do ChatGPT destaca os desafios no desenvolvimento e teste de modelos avançados de IA. Apesar da resposta rápida da OpenAI e da rápida resolução do problema, a situação levantou questões sobre os limites da interação entre humanos e IA. Casos como estes destacam a necessidade de os sistemas de IA serem cuidadosamente monitorizados e avaliados antes da adoção generalizada, para garantir que sejam utilizados de forma segura e ética.