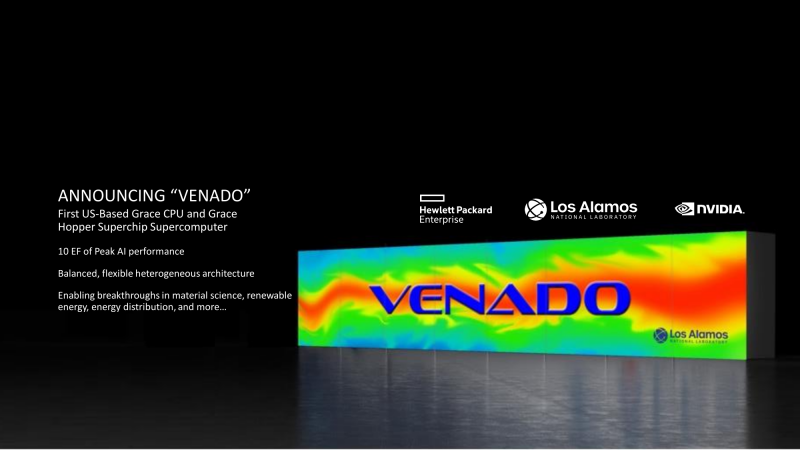

Na ISC 2022, a NVIDIA falou sobre a evolução de seu ecossistema de produtos HPC, que, além de aceleradores e soluções de rede tradicionais, agora inclui seu próprio Arm-chip e DPU da série Grace. Em particular, a empresa, juntamente com a HPE e o Laboratório Nacional Los Alamos (LANL), anunciou o supercomputador Venado Arm.

Venado será o segundo sistema ALPS suíço baseado nos chips NVIDIA Grace Arm anunciado no ano passado e o primeiro desse tipo nos Estados Unidos. Além disso, será uma máquina híbrida que combina um cluster de nós que inclui apenas CPUs e um cluster com aceleradores. Os desenvolvedores criarão em conjunto uma pilha de software que permite a transferência perfeita de cargas de trabalho entre os dois tipos de nós. As características específicas do supercomputador ainda não foram divulgadas, mas já se fala em um desempenho máximo de IA de 10 Eflops (cálculos de precisão mista).

Fonte: NVIDIA

O supercomputador Venado (como o APLS) será construído na plataforma HPE Cray EX, que está se tornando cada vez mais versátil – hoje a HPE anunciou uma colaboração com o desenvolvedor de processadores HPC europeus SiPearl, que ontem anunciou um acordo semelhante com a NVIDIA. Mas a HPE não é mais a única fornecedora desses sistemas. Na ISC 2022, foi anunciado que os sistemas HPC baseados em Grace também estarão disponíveis na Atos, Dell Technologies, GIGABYTE, Inspur, Lenovo e Supermicro. Alguns deles oferecerão suas próprias plataformas, outros oferecerão soluções baseadas na plataforma HGX recentemente atualizada para fornecedores OEM.

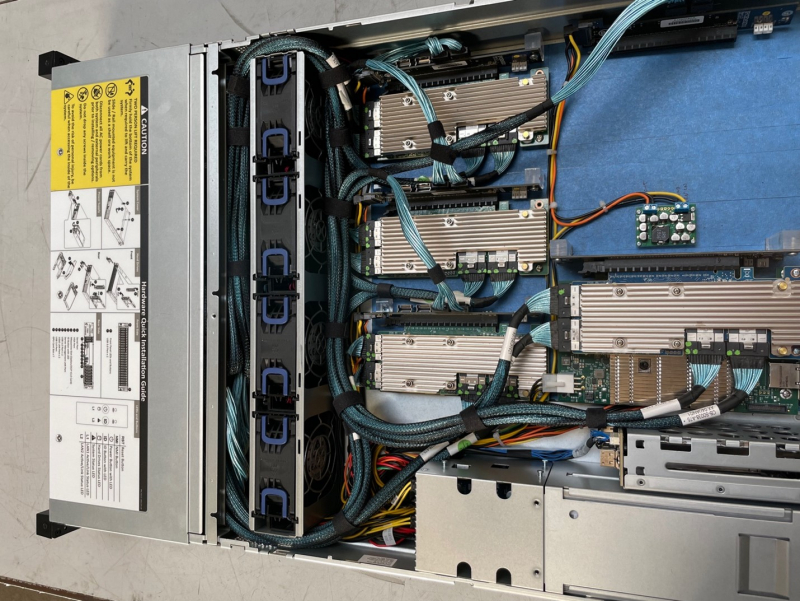

Nó ABOF (Foto: LANL)

Venado não é a única colaboração entre NVIDIA e LANL. Anteriormente, os desenvolvedores falaram sobre o trabalho no armazenamento computacional ABOF (Accelerated Box of Flash), que combina SSD NVMe e DPU BlueField-2. Estes últimos são encarregados da manutenção do sistema de arquivos ZFS, bem como das tarefas de compactação de dados, manutenção de sua integridade etc. Mas esta não é a única função que pode ser confiada ao DPU, sobre o qual a NVIDIA falou repetidamente. As DPUs permitem não apenas acelerar várias operações, mas também usar uma abordagem de nuvem ao usar supercomputadores.

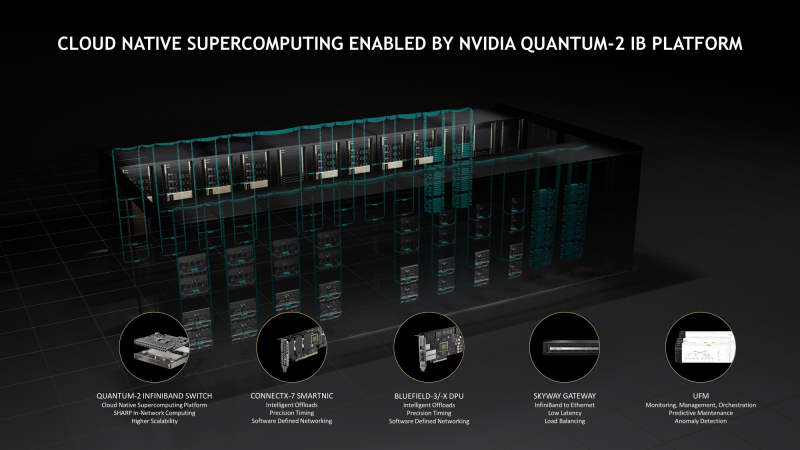

Fonte: NVIDIA

Isso é exatamente o que está sendo alcançado, por exemplo, no Texas Advanced Computing Center (TACC, Texas Advanced Computing Center) para o supercomputador Lonestar6. Especialistas da Ohio State University, Durham University e Technische Universität München estão trabalhando para acelerar o MPI com DPU, enquanto o University College London está trabalhando para tornar o agendador de tarefas mais eficiente. E isso não é todos os projetos.