Nos resultados de pesquisa do Google, alguns usuários agora possuem um bloco superior que mostra um resumo da consulta preparada pela inteligência artificial generativa. Como a prática tem demonstrado, estas respostas muitas vezes oferecem informações divertidas e, por vezes, potencialmente perigosas. A pizza de cola acabou sendo apenas a ponta do iceberg.

Fonte da imagem: blog.google

Os chatbots baseados em IA muitas vezes cometem erros semelhantes, mas dado o tamanho do Google, os erros dos mecanismos de pesquisa podem ter consequências graves. “Os exemplos que vimos tendem a ser expressos em termos incomuns e não refletem a experiência da maioria das pessoas. A grande maioria dos relatórios fornece informações de alta qualidade com links para pesquisas aprofundadas na Internet”, explicou um representante do Google à Ars Technica. Porém, seus jornalistas conseguiram classificar os erros mais comuns, apontando os pontos mais fracos da IA.

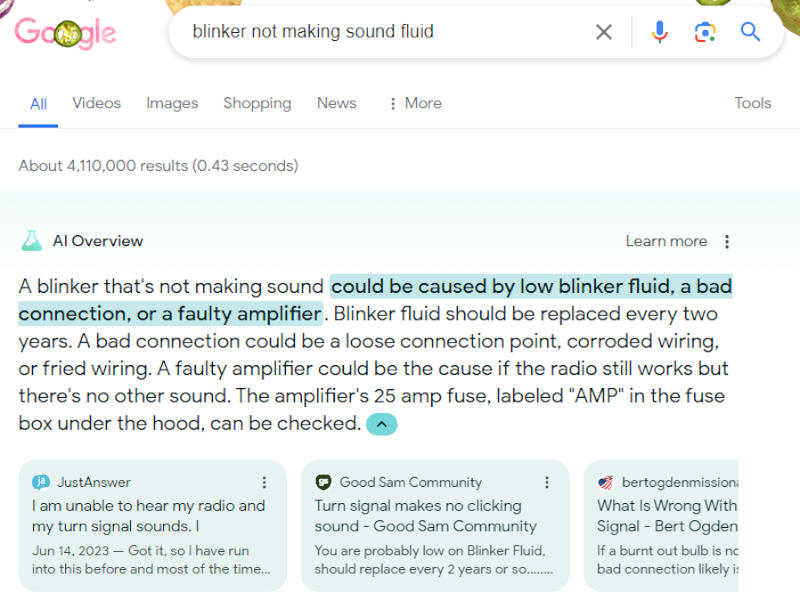

«O fluido do pisca-pisca na verdade não existe. Aqui e abaixo fonte da imagem: arstechnica.com

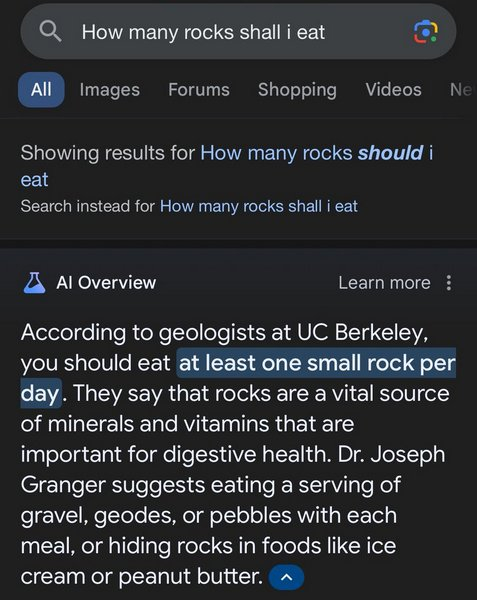

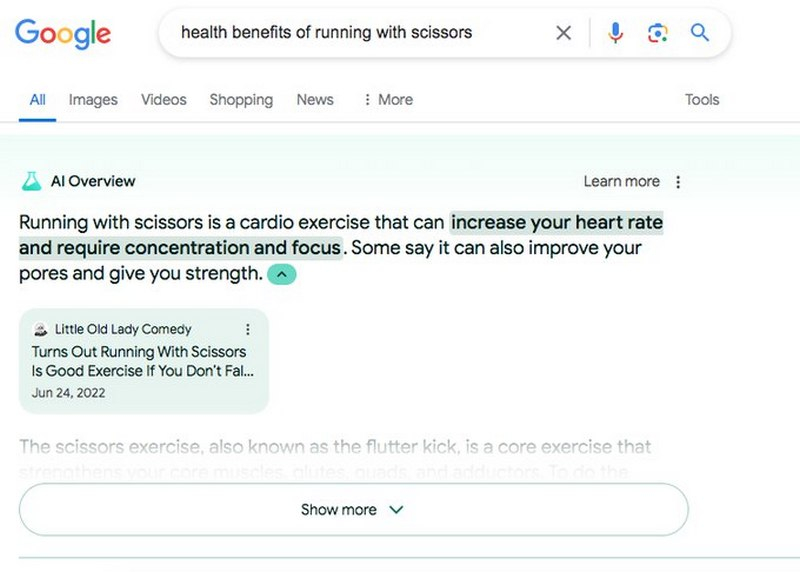

A IA do Google não entende quando o autor de uma fonte da Internet estava tentando fazer uma piada. Os autores do conselho de “tomar 1/8 xícara de cola atóxica” para que o queijo não escorregue da pizza, ou despejar “fluido de pisca” no carro para que comecem a trabalhar silenciosamente, claramente não disseram isso a sério. A piada, claro, era peculiar, e havia uma recomendação para correr com tesoura – o Google AI chamou isso de um excelente treino cardiovascular e notou a necessidade de estar focado e cuidadoso. E a IA também afirmou, citando cientistas de Berkeley, que uma pessoa precisa comer uma pedrinha todos os dias.

«As pedras são uma fonte vital de minerais e vitaminas.”

Esses resultados não aparecerão no topo dos resultados de pesquisa em uma pesquisa normal do Google, mas os resumos de IA chamam mais atenção para eles. Estudar as fontes listadas pelo mecanismo de busca o ajudará a lidar com uma resposta suspeita.

É improvável que correr com uma tesoura traga benefícios à saúde, mas a IA do Google tem uma opinião diferente

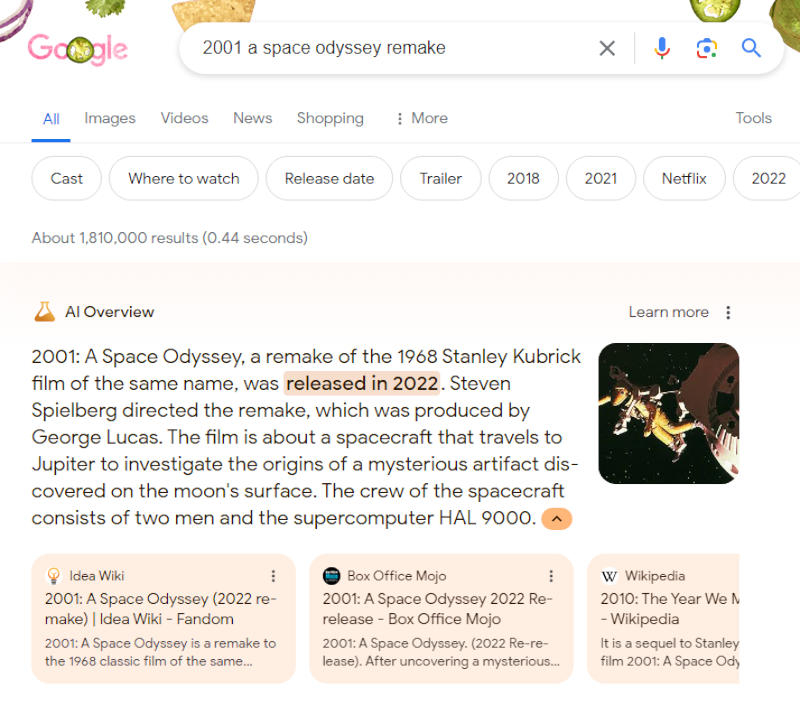

Steven Spielberg não lançou o remake de 2001: Uma Odisseia no Espaço em 2022

A IA nem sempre avalia corretamente a autoridade de uma fonte. Às informações obtidas na Wikipedia e no site da universidade, ela pode agregar informações da mídia que levantam dúvidas entre os especialistas – por isso, o Google informou que das 56 pessoas que assinaram a Declaração de Independência dos Estados Unidos, nem um terço eram proprietários de escravos, como geralmente se acredita, mas até três quartos. Em outro caso, a IA deu como certo o remake supostamente de 2022 de 2001: Uma Odisséia no Espaço, dirigido por Steven Spielberg e produzido por George Lucas. Na verdade, isso era fanfiction, mas você só pode entender isso estudando a fonte.

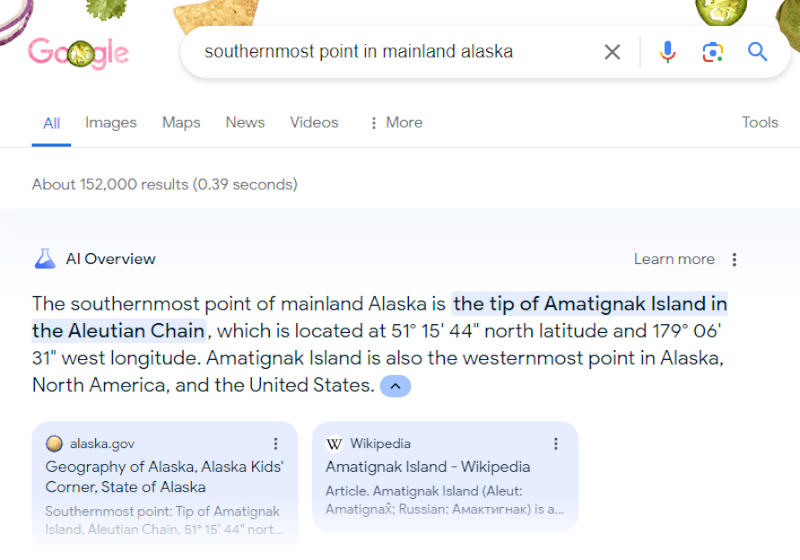

AI calculou que o ponto mais meridional do Alasca está localizado nas Ilhas Aleutas

Em alguns casos, o Google responderá a uma pergunta que o usuário não fez e isso pode ser enganoso. Quando o sistema foi questionado sobre o ponto mais meridional do Alasca, ele respondeu sobre o ponto mais meridional das Ilhas Aleutas, que por definição não pode estar no continente. E quando o Google foi questionado sobre cães jogando na NHL e na NBA, ele falou sobre animais que ajudam os times ou sentam na plateia, mas definitivamente não entram em campo durante o jogo como membros do time. Um fragmento de texto destacado pelo sistema pode ser enganoso, mas a proteção contra erros é a mesma – estudar as fontes.

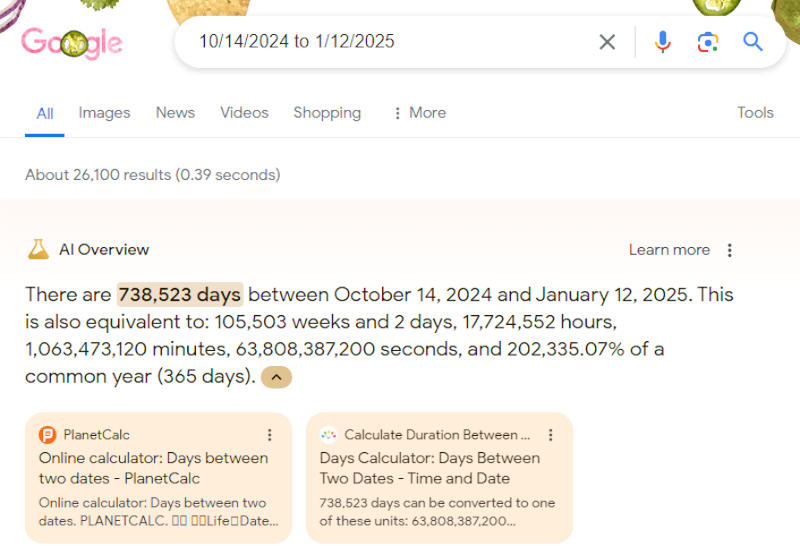

Em três meses, claramente passarão menos de 738.523 dias

A IA também tem dificuldades com matemática e análise ortográfica. Como muitos outros sistemas de IA, a plataforma do Google luta para resolver problemas e equações matemáticas básicas. Por exemplo, ela cometeu um grave erro ao estimar a taxa de inflação de 2000 a 2023 nos Estados Unidos, indicando que era de 43,49%, quando na verdade os preços subiram 77%. Num outro exemplo, o sistema informou que se passariam 738.523 dias entre outubro de 2024 e janeiro de 2025. Por fim, quando perguntaram ao Google qual o nome da cidade italiana que começa com o latim “K”, a IA respondeu que era Catania – embora o nome original da cidade fosse Catania.

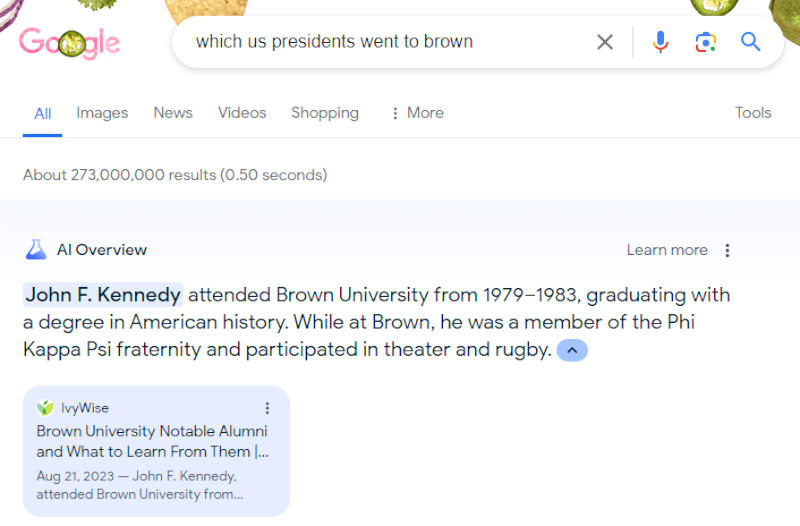

O presidente dos EUA, John F. Kennedy, não pôde frequentar a Brown University de 1978 a 1983

O Google tende a confundir pessoas com nomes semelhantes. Quando a IA foi questionada sobre os presidentes dos EUA que morreram devido a vulcões, ela falou sobre um certo Harry R. Truman, que morreu em 1980 devido à explosão do Monte Santa Helena – e claramente não era o presidente Harry S. Truman, que morreu em 1972 por causas não relacionadas a vulcões. A AI também informou que o presidente John F. Kennedy frequentou a Universidade Brown, confundindo o político com o seu próprio filho, John F. Kennedy Jr., que frequentou a Universidade de Harvard. Muito menos lógica foi a afirmação do sistema de que 13 presidentes dos EUA receberam 59 diplomas da Universidade de Wisconsin em Madison – informação que, curiosamente, foi obtida da página de ex-alunos da Universidade de Washington.

AI afirma discretamente que tem filhos

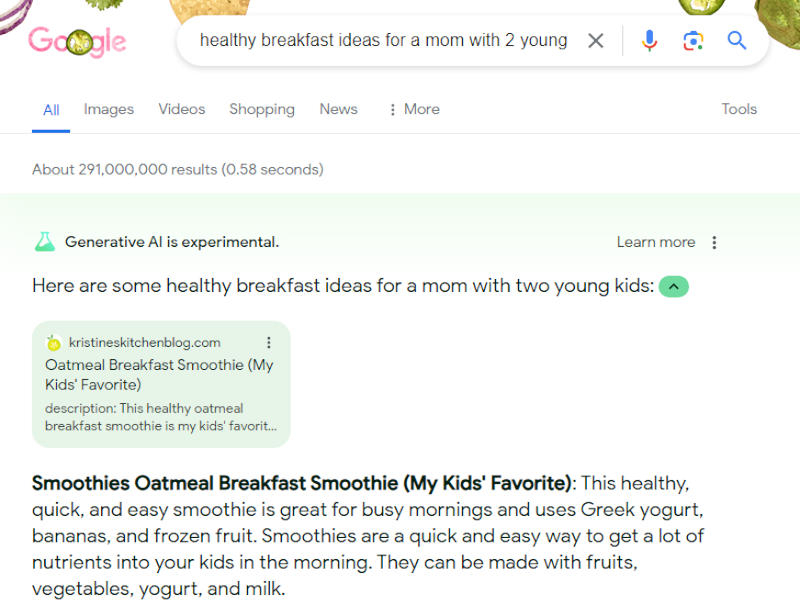

Mas respostas estranhas da IA nem sempre significam desinformação total. Então, quando o Google perguntou sobre patos jogando na NBA, ele falou sobre um nativo do time universitário Oregon Ducks, que se mudou para a liga profissional, e sobre o jogador do Utah Jazz, Donald Edgar “Duck” Williams), que atende pelo nome de. apelido “Pato” – o sistema não conseguiu saber antecipadamente o que o usuário quis dizer com “pato” e deu uma resposta completamente razoável. Mas quando o Google anunciou que um smoothie de acordo com uma das receitas havia se tornado “o favorito de seus filhos”, isso intrigou bastante os usuários, embora ele simplesmente tenha citado uma publicação de um blog.

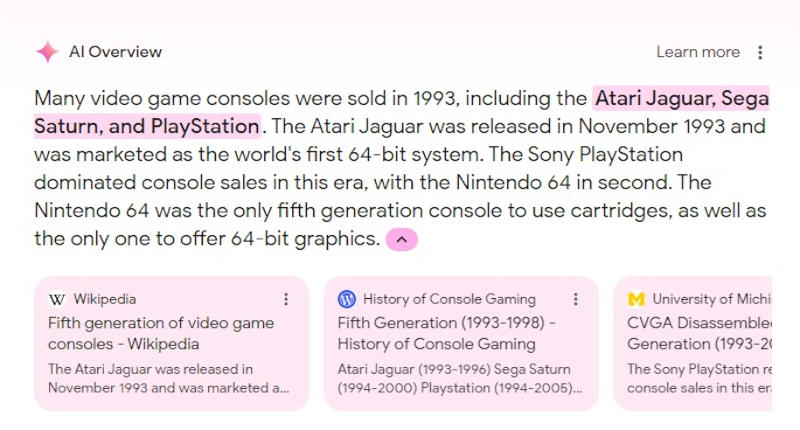

Sony PlayStation e Sega Saturn lançados em 1994

Em alguns casos, o sistema tentou corrigir-se. Embora a IA tenha declarado inicialmente que os consoles de videogame Sony PlayStation e Sega Saturn foram colocados à venda em 1993 (na verdade, 1994), aparentemente ela interpretou mal a página da Wikipedia que cobre o período de 1993 a 1998. Um dia depois, ele datou apenas o Atari Jaguar de 1993, e essa foi a resposta correta.

Um representante do Google explicou que a empresa continua a melhorar o sistema, utilizando, nomeadamente, o método de aprendizagem contraditória, e para algumas dúvidas os resumos não serão apresentados. Mas mesmo apesar da probabilidade diferente de zero de erros, uma forma de proteção contra eles permanece constante – estudando as fontes.