A Microsoft revelou uma atualização radical para seu assistente de IA, Copilot, adicionando visão e voz para torná-lo mais personalizado. Os novos recursos do Copilot incluem um modo de âncora de notícias virtual que lê as manchetes; a função de voz permite que você se comunique com ele naturalmente, como o Advanced Voice Mode da OpenAI; por fim, o assistente de IA pode “ver” para onde o usuário aponta.

Fonte da imagem: blogs.microsoft.com

O Microsoft Copilot foi radicalmente redesenhado nos dispositivos móveis, na versão web e no app para Windows – agora lembra o assistente Pi AI criado pela Inflection, empresa que tem um número significativo de funcionários migrando para a Microsoft. O ex-CEO da Inflection e cofundador do Google DeepMind, Mustafa Suleyman, agora é chefe do departamento de IA da Microsoft. A interface do assistente de IA foi significativamente redesenhada – agora é uma página personalizada do Copilot Discover, mais útil e atraente do que apenas um campo de texto para consultas a um chatbot. A página inicial é customizada com base no histórico do usuário com o chatbot; Com o tempo, ele fornecerá pesquisas úteis, dicas e informações relevantes.

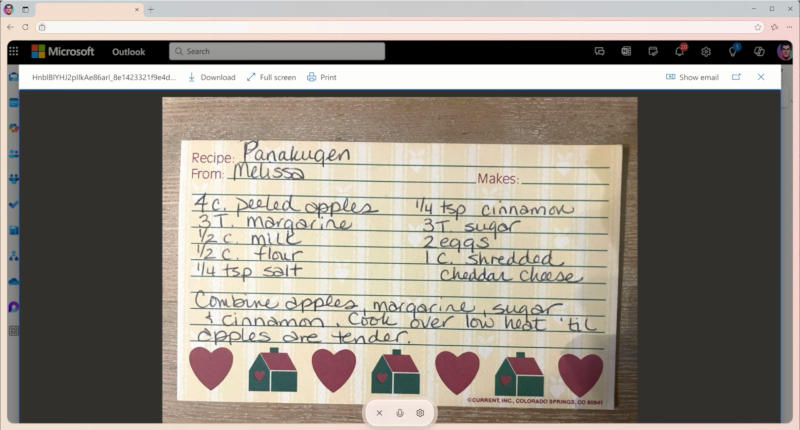

O assistente de IA recebeu uma interface de voz completa semelhante ao ChatGPT – agora você pode se comunicar com ele, fazer perguntas, interrompê-lo, como se estivesse conversando com um amigo ou colega. Existem quatro opções de voz disponíveis no Copilot, uma das quais você deverá escolher na primeira vez que usá-lo. A segunda grande aposta da Microsoft é o Copilot Vision, que permite ao assistente ver o que o usuário vê em uma página aberta. Você pode fazer perguntas sobre textos, imagens ou qualquer outro conteúdo, e o assistente lhe dará uma resposta natural. Isso ajudará na hora de fazer compras online – o sistema oferecerá diversas opções de produtos e avaliações. Você terá que conectar o Copilot Vision manualmente, e o conteúdo visualizado pelo sistema não é armazenado em lugar nenhum e não é usado para treinamento de IA, garante a Microsoft. Além disso, a empresa impôs restrições aos tipos de sites com os quais a Copilot Vision pode trabalhar; O sistema também não oferece suporte a materiais pagos e confidenciais. Em um dos exemplos dados pela Microsoft, a função serve para escanear receitas culinárias manuscritas – a IA explica de que tipo de prato se trata e quanto tempo levará para prepará-lo.

Copilot Daily, outro recurso, apresenta um resumo em áudio de notícias e previsão do tempo que um assistente de IA lê como um locutor. O resumo é uma breve nota que o usuário pode ouvir pela manhã – apenas os recursos que concordaram em usar o conteúdo do Copilot são usados como fontes. Na fase inicial, são a Reuters, Axel Springer, Hearst e o Financial Times, mas no futuro o seu número irá aumentar. O recurso Think Deeper também é promissor – graças aos mais recentes modelos de IA OpenAI, o Copilot agora pode responder a perguntas complexas, oferecendo respostas passo a passo ou fazendo comparações. O recurso permanece em um estágio inicial de desenvolvimento e está disponível no site do Copilot Labs junto com o Copilot Vision – os participantes do teste podem enviar feedback à Microsoft sobre seu trabalho. A empresa está sendo cautelosa por um bom motivo, dadas as preocupações que o recurso Recall causou antes de ser redesenhado.

O pacote Copilot atualizado está disponível em aplicativos móveis para iOS e Android, no site copilot.microsoft.com, bem como no aplicativo Copilot para Windows. O Copilot Voice está inicialmente disponível em inglês na Austrália, Canadá, Nova Zelândia, Reino Unido e EUA, com disponibilidade futura em outras regiões. Atualmente, o Copilot Daily está disponível apenas nos EUA e no Reino Unido, e o Copilot Vision está limitado a assinantes selecionados do Copilot Pro nos EUA.