A OpenAI, em parceria com a AMD, Broadcom, Intel, Microsoft e NVIDIA, anunciou a tecnologia Multipath Reliable Connection (MRC) — um protocolo de rede projetado para melhorar o desempenho e a tolerância a falhas de clusters de GPUs em larga escala, destinados a cargas de trabalho de IA com uso intensivo de recursos. O MRC já está em uso em todos os grandes clusters NVIDIA GB200 da OpenAI, incluindo o primeiro data center Stargate, bem como no data center Fairwater da Microsoft.

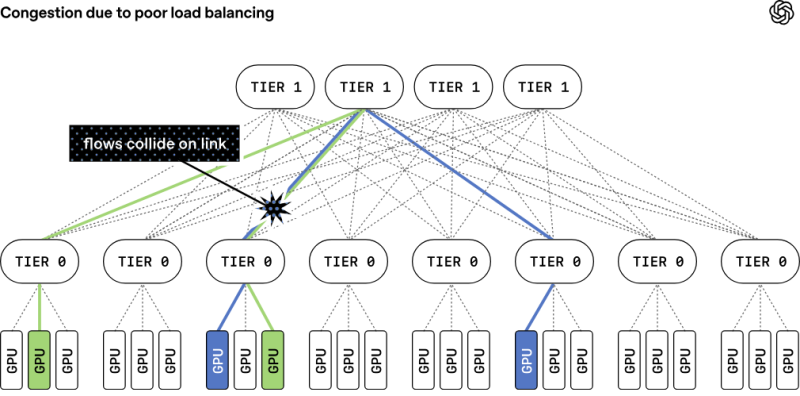

Vale ressaltar que, no treinamento de modelos de linguagem em larga escala (LLM), cada etapa envolve um grande número de transferências de dados entre os nós do cluster. Um único atraso nessas transações pode impactar todo o processo, potencialmente causando indisponibilidade para milhares de aceleradores de IA. Essas interrupções levam à redução da utilização da capacidade computacional disponível e ao aumento do tempo de processamento. As causas mais comuns de atrasos e instabilidade nas transferências de dados são congestionamento de rede, falhas nos canais de comunicação e dispositivos de comutação. Além disso, à medida que os clusters escalam, os problemas se tornam mais graves: as falhas ocorrem com mais frequência e a solução de problemas se torna mais difícil.

O protocolo MRC visa solucionar diversas deficiências importantes das redes Ethernet para infraestruturas de IA. Especificamente, ele introduz mecanismos como transferência adaptativa de dados por múltiplos caminhos, interconexões multicanal em redes Ethernet, distribuição de pacotes, recuperação rápida de falhas e muito mais. O MRC altera fundamentalmente a forma como o tráfego é transmitido pela rede.

Fonte da imagem: OpenAI

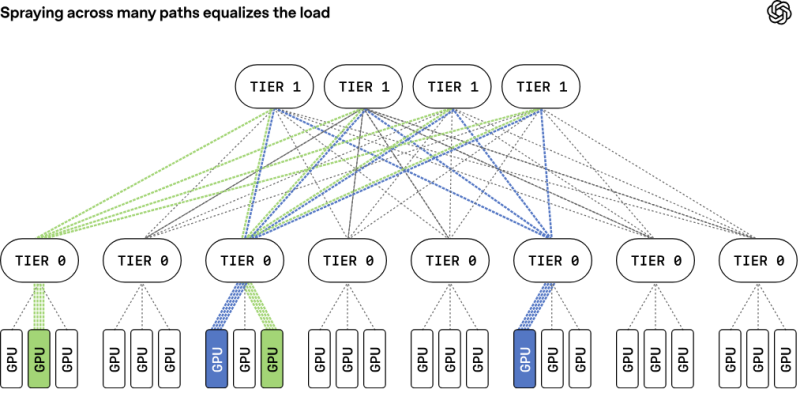

As plataformas RoCE tradicionais normalmente vinculam os fluxos de dados a um único caminho de rede, o que pode reduzir a eficiência durante interrupções. O MRC, por outro lado, distribui pacotes de um único lote simultaneamente por centenas de caminhos e múltiplos links de rede físicos. Os pacotes contêm informações sobre seu destino final, permitindo que os aceleradores sequenciem os dados mesmo que os pacotes cheguem fora de ordem. O MRC mantém informações de estado em vários caminhos: se algum deles estiver sobrecarregado, uma rota alternativa é selecionada, permitindo um balanceamento de carga rápido em toda a rede.

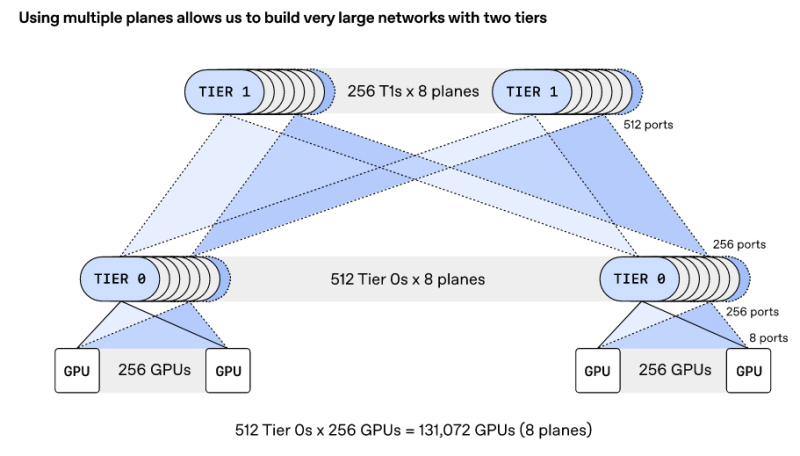

Outra característica fundamental do MRC é sua arquitetura de múltiplas camadas, que altera o próprio conceito físico de construção de interconexões. Por exemplo, uma interface de rede de 800 GbE pode ser dividida em canais de 100 GbE conectados a oito switches diferentes por meio de links separados. Isso permite a criação de oito redes paralelas independentes. Essa abordagem impacta significativamente a estrutura do cluster. Especificamente, um switch com 64 portas de 800 GbE pode ser usado em uma configuração de 512×100 GbE. Isso possibilita a construção de uma rede conectando aproximadamente 131.000 GPUs usando apenas duas camadas de comutação, em comparação com as topologias tradicionais de três ou quatro camadas.

O protocolo MRC também utiliza uma nova abordagem para lidar com congestionamento e perda de pacotes em redes Ethernet. Embora o PFC (Controle de Fluxo Prioritário) seja normalmente utilizado, esse mecanismo envolve a suspensão da transmissão de dados para classes de tráfego específicas, em vez de para toda a porta. O MRC utiliza uma abordagem diferente, baseada em confirmações seletivas, solicitações explícitas de retransmissão e truncamento de pacotes. Quando um switch encontra congestionamento, ele pode truncar a carga útil e encaminhar apenas o cabeçalho do pacote para o destino, permitindo que o destinatário identifique rapidamente os dados ausentes e solicite a retransmissão. Alega-se que isso possibilita a recuperação de falhas e congestionamento em microssegundos, o que é ordens de magnitude mais rápido do que as arquiteturas convencionais.

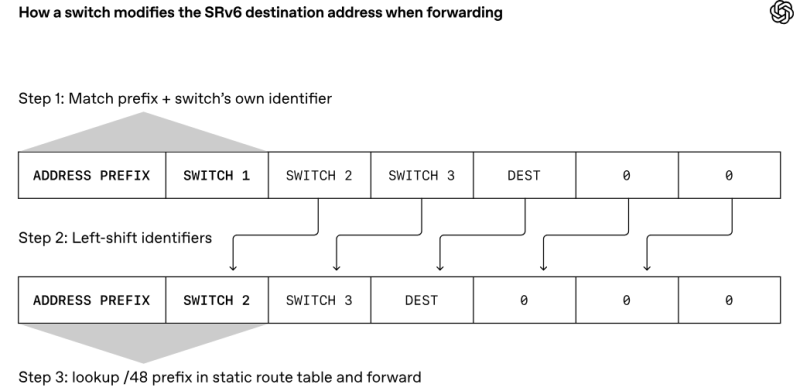

Com a implementação do MRC, a necessidade de roteamento dinâmico é reduzida. Se pacotes forem perdidos em algum caminho, um sistema baseado em MRC simplesmente para de usar esse caminho. Em vez de roteamento dinâmico, utiliza-se o chamado Roteamento de Segmentos IPv6 (SRv6), que permite ao remetente especificar diretamente o caminho do pacote, fornecendo uma sequência de identificadores de switch. Ao encaminhar dados, um switch verifica a presença de seu próprio identificador. Se houver um, ele remove seu identificador do pacote e busca o próximo identificador em uma tabela de roteamento estático, que especifica para onde o pacote de dados deve ser enviado.

Ao contrário do roteamento dinâmico, esta tabela estática é criada quando o switch é configurado pela primeira vez e não é modificada posteriormente. O MRC usa SRv6 para encaminhar pacotes por todos os links físicos e camadas, bem como por múltiplos caminhos dentro de cada um. Se um caminho ficar indisponível, o sistema o ignora. Os switches não precisam recalcular rotas nem executar qualquer outra ação além de seguir rigorosamente as rotas estáticas armazenadas na tabela.

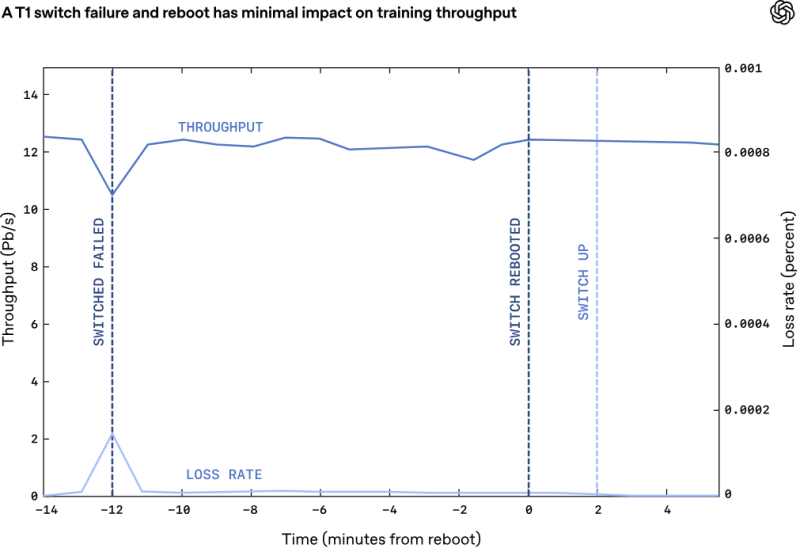

O protocolo MRC foi lançado como parte do projeto OCP. De forma geral, o MRC oferece três vantagens principais em relação às redes Ethernet padrão para clusters de IA. Primeiro, o MRC permite a criação de infraestruturas de alta velocidade e em várias camadas para plataformas com mais de 131.072 endpoints, utilizando apenas duas camadas de switches. Segundo, a distribuição adaptativa de pacotes garante um balanceamento de carga eficiente, eliminando virtualmente o congestionamento no núcleo da rede. Terceiro, o uso do SRv6 garante uma recuperação rápida de falhas e o encaminhamento de pacotes apenas por caminhos funcionais.

A Broadcom anunciou que seus adaptadores de rede Thor Ultra, assim como os switches Tomahawk 5 e Tomahawk 6, oferecem suporte nativo à funcionalidade MRC. Especificamente, o Thor Ultra permite o uso de 2, 4 ou 8 redes paralelas em uma única porta e distribui o tráfego simultaneamente por 128 canais. O Tomahawk 5 oferece capacidade de comutação de até 51,2 Tbps, enquanto o Tomahawk 6 oferece até 102,4 Tbps. A NVIDIA, por sua vez, observa que o protocolo MRC, sendo uma extensão do RoCE, é compatível com as soluções Ethernet Spectrum-X. A OpenAI já utilizou o MRC para treinar diversos modelos de IA usando switches Broadcom e NVIDIA. O MRC compete com o Ultra Ethernet, que é similar em muitos aspectos.

Se você notar algum erro, selecione-o com o mouse e pressione CTRL+ENTER. | Você consegue escrever um melhor? Ficaremos felizes em receber seu feedback.

Fontes: