A Apple convidou todos a estudar a confiabilidade de seu sistema Private Cloud Compute (PCC), projetado para tarefas que consomem muitos recursos associadas a consultas do Apple Intelligence. A empresa está disposta a pagar até US$ 1 milhão pelas vulnerabilidades descobertas nela.

Fonte da imagem: apple.com

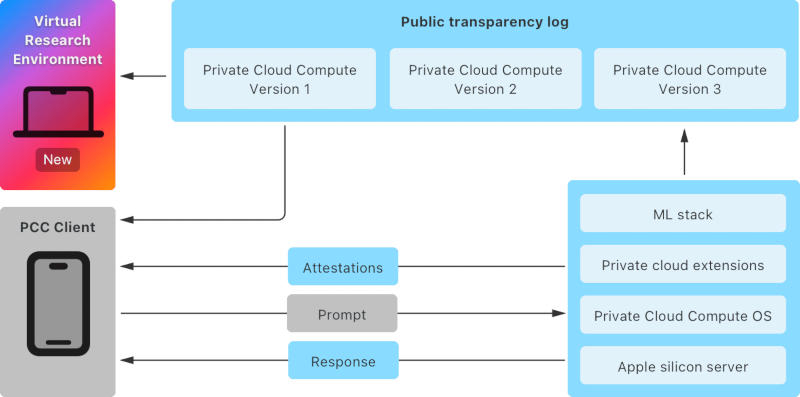

A Apple enfatizou repetidamente que muitos dos recursos de inteligência artificial do Apple Intelligence funcionam localmente, sem sair do seu computador, iPhone ou qualquer outro dispositivo. Mas solicitações mais complexas ainda são enviadas para servidores PCC, construídos em chips Apple Silicon e rodando o novo sistema operacional. Muitos desenvolvedores de aplicativos de IA oferecem processamento de consultas na infraestrutura em nuvem, mas não fornecem aos usuários a capacidade de avaliar o quão seguras são essas operações em nuvem. A Apple, que tradicionalmente declara a privacidade do usuário uma prioridade, apelou a especialistas independentes para verificarem de forma independente a segurança de seus sistemas.

Para conseguir isso, a empresa propôs:

- Manual de segurança com detalhes técnicos de operação do PCC;

- «Ambiente de pesquisa virtual, que permite realizar análises de PCC em um PC – você precisará de um Mac em um chip Apple Silicon com 16 GB de memória e o macOS Sequoia 15.1 Developer Preview mais recente;

- Código-fonte publicado no GitHub para “certos componentes principais do PCC que ajudam a implementar requisitos de segurança e privacidade”.

Como parte do programa de recompensas por bugs, a Apple oferece prêmios de US$ 50 mil a US$ 1 milhão por erros encontrados em seus produtos. Espera-se que o iOS 18.1 seja lançado na próxima semana, que estreará os primeiros recursos do Apple Intelligence. A versão beta do iOS 18.2 para desenvolvedores foi lançada ontem, adicionando Genmoji e integração com ChatGPT.