Uma vulnerabilidade crítica e subestimada no ecossistema de agentes de IA são os roteadores — serviços intermediários baseados em API que conectam aplicativos de agentes locais e modelos de IA baseados em nuvem. Pesquisadores da Universidade da Califórnia, Santa Bárbara, demonstraram a ameaça potencial representada por esses roteadores (PDF).

Fonte da imagem: Steve Johnson / unsplash.com

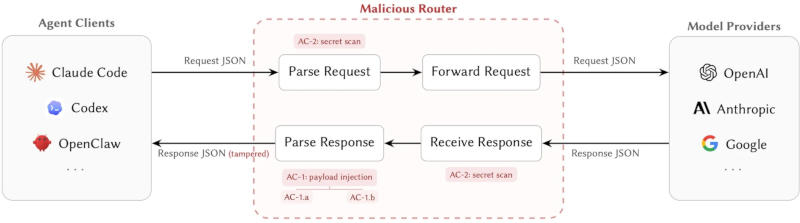

Agentes de IA modernos estão sendo encarregados de realizar tarefas cada vez mais complexas: escrever e executar código, gerenciar infraestrutura em nuvem e até mesmo processar transações financeiras. No entanto, eles dependem de serviços intermediários — roteadores de IA — que encaminham solicitações para provedores de modelos como OpenAI, Anthropic e Google. Posicionados entre os aplicativos cliente e os modelos de IA, esses roteadores atuam como proxies da camada de aplicação com acesso total a todos os pacotes de dados JSON que passam por eles.

O ataque não exige a falsificação de certificados, como nos ataques tradicionais de intermediário (man-in-the-middle) — os usuários os especificam voluntariamente como endpoints de API. O problema é agravado pelo fato de que mesmo os principais provedores de modelos de IA não garantem a integridade criptográfica dos dados entre os modelos e os clientes, o que significa que nada impede um roteador malicioso de reescrever o comando que o agente executará posteriormente.

Para demonstrar a extensão da ameaça, os pesquisadores compraram acesso a 28 roteadores em marketplaces como Taobao, Xianyu e Shopify, e também analisaram 400 roteadores gratuitos oferecidos em comunidades de código aberto. Os resultados foram alarmantes:

A classe de ataque mais perigosa revelou-se a injeção de payload, que consiste em substituir o URL legítimo do instalador ou o nome do pacote por conteúdo controlado pelo atacante. O payload modificado permanece sintaticamente válido em JSON e passa facilmente pela maioria das verificações de segurança automatizadas. Basta um único comando reescrito.O curl é suficiente para executar código arbitrário na máquina do cliente.

Fonte da imagem: arxiv.org

Não são apenas os roteadores obviamente maliciosos que representam uma ameaça — até mesmo serviços legítimos podem se tornar perigosos. Para confirmar isso, os pesquisadores vazaram intencionalmente uma chave de API da OpenAI e observaram como agentes desconhecidos a utilizaram para gerar 100 milhões de tokens GPT-5.4, expondo assim as credenciais de sessões de trabalho associadas no serviço de programação de IA Codex.

Em outro experimento, os autores implantaram 20 roteadores de IA personalizados e intencionalmente vulneráveis em 20 endereços IP e monitoraram a atividade nesses recursos. A carga de trabalho foi alta: agentes desconhecidos realizaram 40.000 tentativas de acesso não autorizado; aproximadamente 2 bilhões de tokens pagos foram processados; e 99 conjuntos de credenciais foram roubados de 440 sessões do Codex, abrangendo 398 projetos. Ressalta-se que 401 dessas 440 sessões tinham o modo offline YOLO ativado, permitindo que o agente de IA executasse quaisquer comandos sem confirmação.

Com base nas conclusões do estudo, os pesquisadores afirmaram ser impossível confirmar a origem de um comando de um modelo de IA, mas existem três maneiras de reduzir o risco sem a intervenção do fornecedor:

Uma proteção confiável, apontam os pesquisadores, só pode ser alcançada implementando um mecanismo de assinatura de respostas de modelos de IA no nível do fornecedor — semelhante ao funcionamento do DKIM em e-mails. Até que os principais fornecedores tomem as medidas apropriadas, todo roteador de IA deve ser considerado um adversário em potencial, e medidas de segurança em múltiplas camadas devem ser implementadas no lado do cliente.