Qualquer pessoa não budista que tenha ao menos vagamente ouvido falar desse antigo ensinamento sabe que, para alcançar a iluminação, é preciso livrar-se do desejo. Portanto, um ser iluminado é paradoxalmente dualista: sabe tudo, mas não deseja nada. Não seria a IA atual semelhante — desprovida de aspirações, motivações ou paixões próprias, em última análise, mas simplesmente cumprindo, com a paciência de um verdadeiro bodhisattva, as demandas de seres humanos presos no samsara? É verdade que a qualidade da iluminação nos modelos generativos modernos não é muito alta; considere, por exemplo, sua inescapável tendência a alucinações. E, falando estritamente, eles não alcançaram o nirvana por si mesmos — por seus próprios esforços. Certamente, o processo de eliminação da ignorância, da insatisfação e da ansiedade não pode ser considerado a formação de pesos nas entradas dos perceptrons de uma rede neural densa e profunda durante seu treinamento, que, em última análise, se resume a uma operação de multiplicação de matrizes? Mais precisamente, a eliminação da ignorância pode de fato ocorrer dessa maneira (embora sua qualidade seja questionável, como diremos novamente), mas um modelo de linguagem amplo (LLM), mesmo em seu estado inicial, com um conjunto estritamente nulo de pesos, certamente não possui insatisfação nem ansiedade.

Então, talvez esse seja o ponto principal — a ausência inerente de imperfeições sensoriais em modelos generativos (um estado de falso nirvana), sem cuja superação, por sua vez, eles não podem alcançar o verdadeiro nirvana? Então, e se pudéssemos criar uma inteligência artificial, inicialmente sobrecarregada com todas as deficiências humanas, e de alguma forma conseguíssemos eliminá-las durante o processo de treinamento?(Mais uma vez, ainda que imperfeitamente), então o resultado será a notória inteligência artificial geral (IAG)? Mas como podemos fazer uma máquina adquirir consciência — sem a qual não podemos nem falar sobre questões emocionais como insatisfação e ansiedade?

“Para nos livrarmos dos desejos, primeiro precisamos adquiri-los, e se fizermos isso através do Caminho Óctuplo, não teremos energia suficiente” (fonte: geração de IA baseada no modelo Seedream v. 5.0 lite)

⇡#Se eu fosse como Buda

Antes de considerarmos a prontidão, ou mesmo o potencial, da inteligência artificial para compreender o Caminho Óctuplo, vamos analisar a visão da consciência sob a perspectiva das ciências naturais. Primeiramente, vamos explicar a conexão entre consciência e inteligência forte (semelhante à humana) — e por que a primeira pode ser considerada um pré-requisito fundamental para alcançar a segunda. A inteligência humana, em termos práticos (não filosóficos), é frequentemente definida como uma capacidade cognitiva natural, ou seja, evoluída, que permite ao seu portador aprender com a experiência, adaptar-se a novos ambientes, raciocinar abstratamente e aplicar julgamentos emocionais e morais ao tomar decisões. Deixemos de lado, por ora — até que haja contato com outras civilizações —, a questão de se uma inteligência que não seja humana pode surgir naturalmente. As pessoas projetam a IAG (Inteligência Artificial Geral) por conta própria e determinarão o sucesso de sua criação comparando suas capacidades com as suas próprias: não há como escapar disso. Isso significa que, pelo menos, o primeiro passo para a criação de uma inteligência artificial plenamente desenvolvida (o próximo passo poderia ser a superinteligência, SI, que já discutimos), em vez de simplesmente um robô alucinatório e onisciente, deve ser uma inteligência semelhante à humana.

O termo “semelhante” nesta fórmula é um esclarecimento importante: assim, ao longo de sua evolução, os seres humanos observaram o voo.Na criação de máquinas voadoras artificiais, as aves foram frequentemente consideradas e, de muitas maneiras, serviram de inspiração. Mas, em última análise, nem aviões, nem helicópteros, nem, principalmente, foguetes conquistam os céus com o bater de asas dos pássaros (os ornitópteros existem como classe, mas permanecem exóticos e impraticáveis). Os desenvolvedores atuais de IAG (Inteligência Artificial Geral) operam com base em uma lógica semelhante: embora seja impossível prever exatamente como a inteligência artificial “decolará”, um exemplo natural de inteligência artificial está bem ali, diante de seus olhos (e também atrás deles). Em outras palavras, julgar se o mais recente candidato a IAG “decolou”, mesmo que apenas inicialmente, terá que ser feito inevitavelmente usando padrões humanos: ainda não existe outro. Mas a estrutura desse padrão não é abstratamente filosófica, mas sim essencialmente científica: evolutiva, biológica e antropológica. E aqui chegamos a um ponto importante: a inteligência dos seres biológicos surgiu mais tarde do que a consciência, significativamente mais tarde. Os “julgamentos emocionais e morais” mencionados na definição aplicada de inteligência não caem do céu — embora muitos discordem dessa tese — mas sim se desenvolvem organicamente, como manifestações da consciência em primeiro lugar. Então, talvez devêssemos primeiro criar consciência artificial — e só depois partir para a Inteligência Artificial Geral (IAG)?

Leonardo da Vinci já havia vislumbrado a ideia de voar como um pássaro em um esboço inspirado — embora nem mesmo o homem mais robusto conseguisse erguer tal estrutura, especialmente uma feita com materiais disponíveis no século XVI, usando apenas sua força muscular (fonte: Britannica).

Essa questão se complica pelo fato de que a consciência, como conceito científico fundamental (para não mencionar seus aspectos filosóficos), é extremamente difícil de definir; não é à toa que é chamada de “Proteu da filosofia”. Em termos práticos, a consciência pode ser vista como uma manifestação de experiências subjetivas de eventos no mundo externo; a capacidade do indivíduo de compreender o que lhe acontece pessoalmente e ao seu redor. Essa é a diferença fundamental entre atividade consciente e atividade instintiva, programada em nível biológico: organismos conscientes demonstram maior adaptabilidade individual às mudanças nas condições ambientais. Precisamente individual: os organismos mais numerosos do planeta — se os contarmos pelo seu número — são bactérias (ou, mais precisamente, procariontes). Mesmo sem sistema nervoso — mas ao custo da extinção contínua e a longo prazo de miríades de indivíduos menos bem-sucedidos — eles conseguiram se adaptar notavelmente bem a uma ampla variedade de condições, desde as “fumarolas negras” do fundo do oceano até os desertos do Ártico. Mas apenas um mesmo ser humano, como portador da inteligência mais elevada do planeta, agindo em conjunto com a consciência, pode, graças aos dispositivos artificiais que cria, desde roupas feitas de peles de animais até veículos tripulados para águas profundas, existir e funcionar sem danos em qualquer um dos ambientes fisicamente acessíveis. No espaço sideral, as coisas ainda são complicadas — a radiação alémO campo magnético da Terra é extremamente forte — mas também há avanços nessa área. Como observou Erwin Schrödinger, um dos fundadores da mecânica quântica e cientista com vasto conhecimento, em suas “Palestras Populares”, a consciência está ligada à aprendizagem da matéria viva, ou seja, às funções da atividade nervosa superior que, em um indivíduo, se auto-adaptam em resposta à sua experiência de estar em um ambiente em constante mudança.

Em resumo, sem aprendizagem, não há consciência — e sem consciência, aparentemente, não se pode alcançar uma inteligência forte, nem artificial nem natural. Em 2002, Daniel Kahneman, o primeiro psicólogo a ganhar o Prêmio Nobel de Economia, descreveu detalhadamente dois mecanismos de pensamento fundamentalmente diferentes, anteriormente chamados de “Sistema 1” e “Sistema 2”. O primeiro desses mecanismos é rápido e instintivo: sinais dos receptores olfativos chegam ao cérebro, são reconhecidos como o aroma de batatas fritas em banha com alho, uma sensação de fome surge repentinamente, a mão alcança a frigideira — adeus, dieta! O “Sistema 2”, ao contrário, é lento, ponderado e exige um esforço cognitivo consciente: enquanto a mão ainda não alcançou o alvo, esse mecanismo é capaz de acessar da memória de longo prazo lembranças de horas passadas na academia, de um feriado próximo em que a mesa certamente estará farta, de uma promessa feita a si mesmo de definitivamente emagrecer até o verão — e, se o sinal proveniente dele superar os impulsos do “Sistema 1”, talvez a tentação seja vencida. O importante aqui é que ambos os sistemas cognitivos trabalham juntos, aprimorando (de uma perspectiva evolutiva)(mesmo considerando toda a espécie, não apenas um indivíduo) o processo de tomada de decisão como um todo. Em situações familiares, o “Sistema 1” garante rapidez e precisão na resposta, mas é propenso a erros sistemáticos, especialmente ao resolver novos problemas — e é aí que o “Sistema 2” entra em ação, munido de lógica, estatística e outras ferramentas poderosas. É verdade — tal é a nossa peculiaridade como seres biológicos — que somos incapazes de sobrepor-nos completamente ao “Sistema 1” de forma arbitrária e, por essa mesma razão, a implementação dos conselhos sensatos do “Sistema 2” está longe de ser sempre como o esperado. Mas esses são problemas superficiais, enquanto a IA moderna, baseada na BNM, corresponde (na melhor das hipóteses!) apenas ao “Sistema 1”, sem lógica, abstrações ou introspecção.

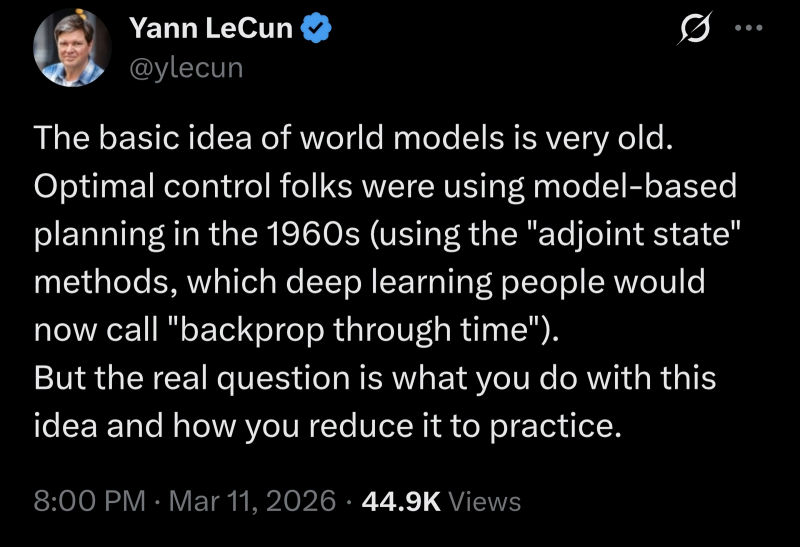

O método de estado adjunto em aprendizado de máquina que LeCun menciona neste tweet tem suas raízes na teoria do controle ótimo desenvolvida em meados do século passado por Lev Pontryagin e seus alunos. Veja “Princípio do Máximo de Pontryagin”: encontrar o melhor controle possível para a transição de um sistema dinâmico de um estado para outro, especialmente na presença de restrições nos controles de estado ou entrada (fonte: X)

⇡#Diga “AMIGO” e entre no modelo mundial

No final de 2025, Yann LeCun, renomado pioneiro no campo da inteligência artificial, vencedor do Prêmio Turing e cidadão dos Estados Unidos e da França, sabiamente abandonou o extremista Meta✴*—expressando mais uma vez sua convicção de que o BNM, apesar de seu apelo para resolver muitos problemas aplicados no desenvolvimento da IAG, é um beco sem saída. Já em meados de março de 2026, sua startup Advanced Machine Intelligence Labs, ou simplesmente AMI (semelhante à palavra francesa para “amigo”), dedicada à pesquisa na área de IA forte, anunciou ter captado impressionantes US$ 1,03 bilhão em financiamento inicial. Investidores estimaram o valor da empresa, fundada em janeiro e com sede em Paris e escritórios em Nova York, Montreal e Singapura, em US$ 3,5 bilhões. A AMI pretende desenvolver “modelos mundiais” para ensinar à IA ideias preditivas sobre o ambiente em que terá de operar, com base em observações do mundo real. Isso demonstra o grande interesse em um caminho de desenvolvimento tão não convencional e, ao mesmo tempo, o crescente ceticismo dos investidores em relação aos métodos tradicionais e abrangentes de IA.A lista de participantes da primeira rodada de financiamento da AMI revela a entrada de trilhões de novos parâmetros no Modelo de Navegação Baseado em Resultados (BNM) sem uma revisão fundamental do próprio paradigma de treinamento. Incluía não apenas grandes fundos — Cathay Innovation, Greycroft, Hiro Capital, HV Capital e Bezos Expeditions (através desta última, o fundador da Amazon, Jeff Bezos, aloca seus fundos pessoais para projetos que ele apoia) — mas também grandes empresas como Nvidia, Toyota e Samsung. Tim Berners-Lee, o “pai da World Wide Web”, e o ex-executivo do Google, Eric Schmidt, também investiram seu próprio dinheiro no novo caminho para a Inteligência Artificial Geral (IAG).

A crescente preocupação com a sabedoria do extenso caminho de desenvolvimento da IA (promovido talvez com mais persistência pela OpenAI e pelo próprio Sam Altman) é sublinhada pela magnitude da diferença entre o valor do investimento que LeCun planejava inicialmente arrecadar em sua primeira rodada de financiamento — cerca de € 500 milhões — e o resultado final: € 890 milhões; o equivalente a US$ 1,03 bilhão. Como resultado, a AMI se encontra em uma posição tão vantajosa que pode escolher de forma independente de quem captar recursos (e, consequentemente, quais compromissos assumir com os investidores) — um luxo que startups de IA normalmente não podem se dar ao luxo de ter. Agora, presumivelmente, nada impedirá LeCun de continuar modelando mundos — o que, aliás, ele vem fazendo há anos — e, mais cedo ou mais tarde, provar a validade de sua abordagem para a criação de uma IAG (Inteligência Artificial Geral).A abordagem é a seguinte: em vez de uma previsão autorregressiva passo a passo (com a adição de uma certa quantidade de estocástica) do que será o próximo token no conjunto geradoUm modelo em cadeia, como o BNM, precisa migrar para um nível de abstração mais elevado; para enxergar a floresta em vez das árvores. Isso pode ser alcançado usando a estrutura JEPA (arquitetura preditiva de incorporação conjunta), proposta pelo próprio Yann LeCun em 2022. Aliás, o pesquisador conseguiu implementar diversas iterações dela enquanto ainda trabalhava na extremista Meta✴*, mas então suas visões sobre o desenvolvimento da IA divergiram das de Mark Zuckerberg, e LeCun optou pela liberdade.

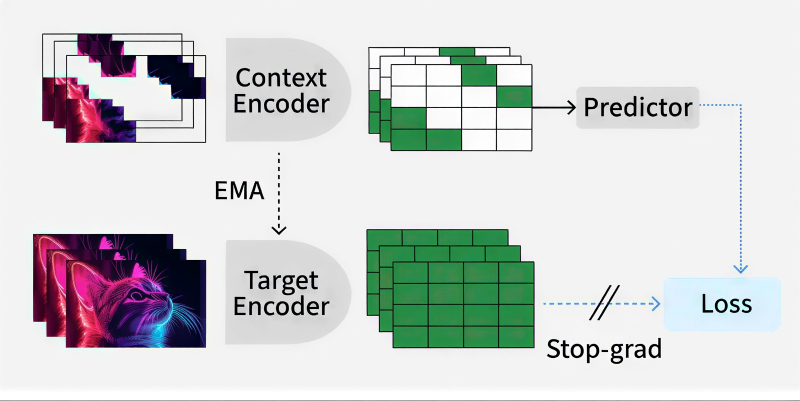

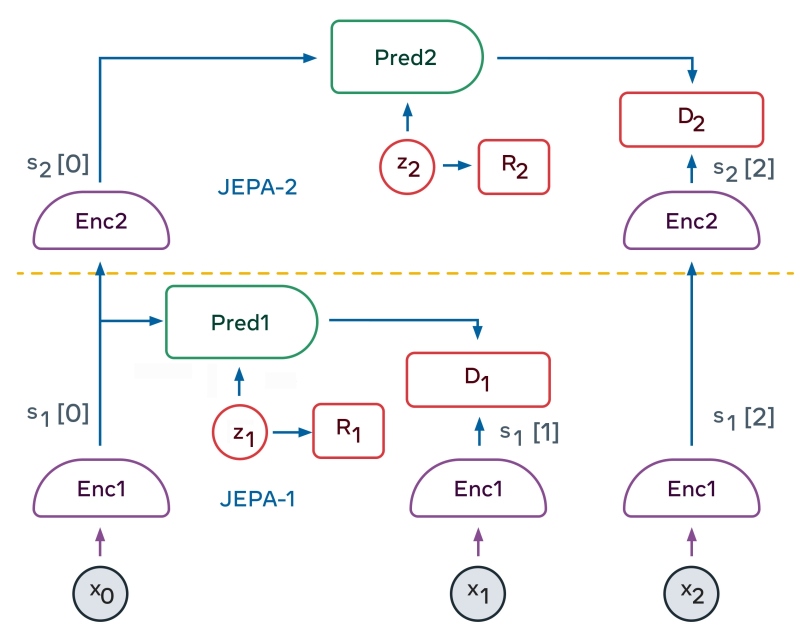

O esquema básico de treinamento do JEPA é o seguinte: o codificador de contexto processa a parte dos dados que está aberta ao sistema (o próprio contexto) e forma sua representação vetorial no espaço latente; o codificador de alvo processa a parte dos dados que o sistema precisa prever (o alvo) e forma a representação vetorial do alvo; o preditor recebe a representação vetorial do contexto e prevê a representação vetorial do alvo com base nela; em seguida, minimizando uma função de perda definida especificamente para esse fim, o modelo aprende a reduzir a distância (também no mesmo espaço latente de altíssima dimensionalidade) entre a representação vetorial do alvo prevista e a representação vetorial do alvo real (fonte: GeeksForGeeks).

Em resumo, o JEPA extrai dos dados de treinamento não padrões indiretos e implícitos (“tokens que codificam ‘Vermelho’ devem, com uma probabilidade razoavelmente alta, ser seguidos por tokens correspondentes à palavra ‘área'” — o modelo não só é incapaz de questionar “Por que isso acontece?” ou “O que isso significa?”), mas sim representações abstratas de como o mundo funciona. LeCun e seus colaboradores acreditam que essa abordagem permitirá construir sistemas que compreendam a realidade física da mesma forma que humanos e animais: não por meio da linguagem, mas por meio da experiência corporal.

No campo da cibernética, que lida com robôs e aprendizado de máquina, o paradoxo de Moravec é conhecido desde a década de 1980: “É relativamente fácil fazer com que computadores demonstrem o nível de um adulto em testes de inteligência ou ao jogar damas, mas é difícil ou praticamente impossível dar-lhes as habilidades de uma criança de um ano de idade.””O desenvolvimento da percepção sensorial e das habilidades motoras de uma criança.” Isso também se aplica aos humanos: somos melhores em compreender processos simples que funcionam mal do que processos complexos que funcionam perfeitamente, precisamente porque nossas habilidades — incluindo as cognitivas — foram moldadas pela evolução, por meio da seleção natural. As máquinas, por outro lado, são treinadas para resolver problemas específicos usando uma vasta quantidade de dados acumulados e digitalizados por humanos. As pessoas, no entanto, não têm o menor interesse em descrever as diferenças detalhadas entre uma cadeira e uma xícara, ou as ações precisas necessárias com partes individuais do corpo para se levantar de uma cadeira na sala de estar, caminhar até a cozinha e encher um copo com água. É por isso que os Modelos Naturais de Busca (BNMs), treinados com os conjuntos de dados mais extensos, falham em realizar as tarefas mais triviais (quando são encarregados de controlar robôs, por exemplo): esses conjuntos carecem de informações especificamente importantes.

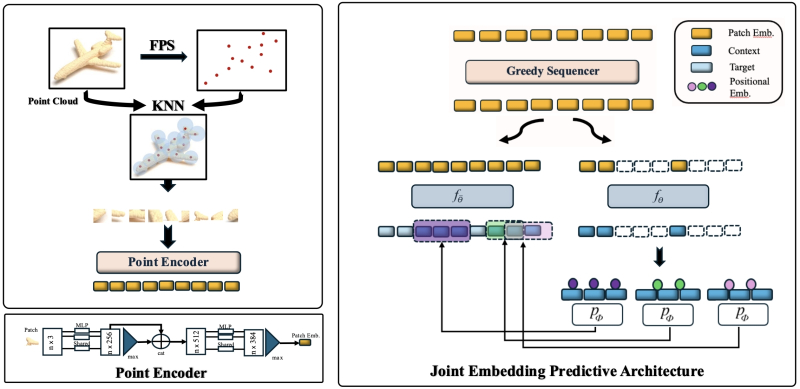

A arquitetura JEPA já está sendo usada para aprendizado baseado em nuvens de pontos (Point-JEPA), permitindo que redes neurais profundas formem representações significativas de uma estrutura completa — ou, mais precisamente, de suas regularidades inerentes, como relações espaciais, consistência geométrica ou invariância estrutural — a partir de um conjunto de dados 3D aproximados, não pré-rotulados manualmente; ou seja, a partir de uma nuvem de pontos (fonte: arxiv.org/abs/2404.16432).

Gerar os dados de treinamento necessários nos volumes requeridos — com o envolvimento de especialistas em biomecânica, por exemplo, e especialmente usando IA existente para a descrição detalhada da cinemática corporal capturada em vídeo — é um beco sem saída: as alucinações inerentes ao aprendizado atual baseado em nuvens de pontos ainda existirão. As redes neurais biológicas, aliás, também estão sujeitas a alucinações (o próprio termo foi originalmente aplicado apenas a humanos), mas, como já enfatizamos repetidamente, a seleção natural atua inexoravelmente sobre os seres vivos. Grosso modo, indivíduos com alucinações frequentemente não conseguem gerar descendentes férteis, então, ao longo de centenas de milhões de anos, as redes neurais biológicas aprenderam a manter a clareza da consciência, por mais modestamente que ela se manifeste em uma determinada espécie. Todo o vasto mundo real atua como um professor (se é que se pode usar o termo da indústria de IA “aprendizado supervisionado” neste caso) em relação aos seres vivos a qualquer momento — desde as leis gerais da física, as características do Sol e as peculiaridades da posição da Terra em sua órbita ao redor dele (a distância média da estrela eA inclinação do eixo de rotação determina a quantidade de energia luminosa que atinge uma área unitária em um determinado ponto) e toda a história geológica anterior (os continentes e oceanos na era dos trilobitas eram significativamente diferentes dos de hoje) influencia o clima atual, a diversidade da biota e o comportamento de suas próprias espécies.

⇡#DigitalCuckoosBelongHere

Acontece, sugere LeCun, que todos os seres vivos do planeta, capazes de responder de uma forma ou de outra às influências ambientais, constroem certos modelos do mundo para si mesmos ao longo da evolução — e então agem de acordo com eles. É precisamente assim que se pode descrever a formação de instintos, e instintos bastante complexos, como alimentar filhotes em pássaros ou construir estruturas em insetos sociais. Um bico aberto, amarelo por dentro, e um guincho exigente são um sinal para os pais lançarem outra minhoca nesse abismo; Um pássaro não raciocina “Eu dei isso a este, eu não dei aquilo”, mas simplesmente age de acordo com um programa fixado no nível genético, que modela adequadamente a realidade — cujo desenvolvimento levou milhões de anos e sabe-se lá quantas gerações de seres vivos. Como qualquer programa, ele pode, é claro, ser hackeado (é por isso que os cucos apareceram — não pela maldade de algum hacker evolucionista, mas de uma forma completamente natural; já que a vulnerabilidade existe objetivamente, ela será explorada). Mas o ecossistema como um todo se adaptará a tal ataque: apenas um filhote de cuco pode aparecer em um ninho de toutinegra, e tal ninho infeliz, na melhor das hipóteses (para os cucos como espécie), abrigará várias dezenas de toutinegras — o dano causado pela exploração da vulnerabilidade existe, mas está no nívelA população é bastante tolerável. Se ao menos a inteligência artificial pudesse ser ensinada a controlar seus próprios impulsos alucinógenos da mesma forma!

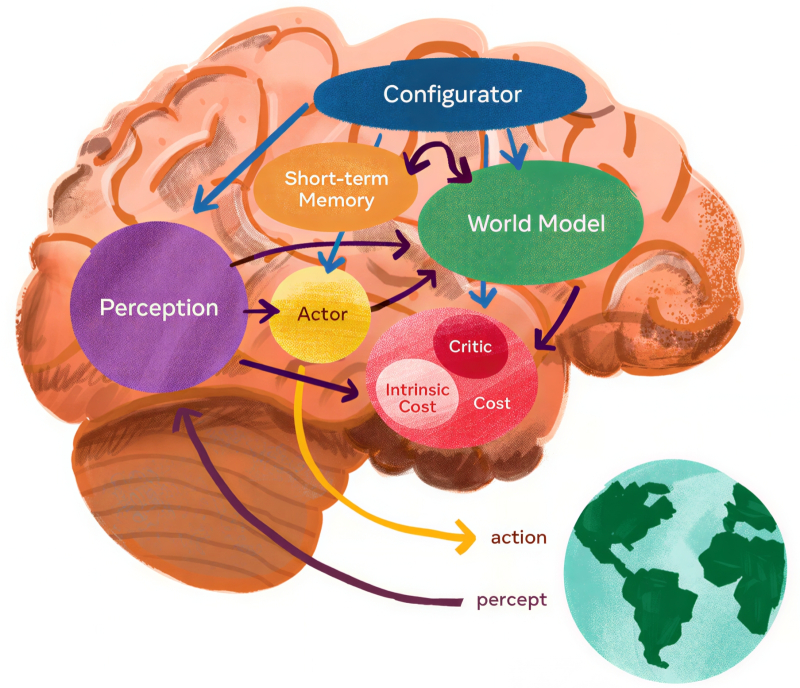

A arquitetura geral de um sistema de inteligência autônoma, proposta por Yann LeCun no início de 2022, resume-se a um modelo de IA que “compreende” o mundo real — com feedback de reforço por meio das reações do mundo às suas ações (fonte: Yann LeCun).

Em 2024, durante uma conferência científica, Yann LeCun afirmou veementemente: “Modelos de linguagem são úteis para uma certa gama de tarefas, mas representam um beco sem saída no caminho para a inteligência artificial de nível humano. Se você é um estudante de doutorado, não se dedique a trabalhar com modelos de linguagem. Concentre-se em encontrar métodos que superem suas limitações fundamentais.” Agora, em março de 2026, ele prometeu aos investidores que, dentro de um ou dois anos, sua AMI iniciaria negociações com parceiros corporativos interessados em aplicações práticas do JEPA e, dentro de três a cinco anos, se tornaria “a principal fornecedora mundial de sistemas inteligentes de propósito geral”, prontos para implantação em qualquer área que exija inteligência artificial robusta. A firme confiança de Yann LeCun nas perspectivas desses modelos de mundo baseia-se no fato de que eles conseguirão implementar três princípios-chave que ele e seus colegas estão incorporando ao seu projeto:

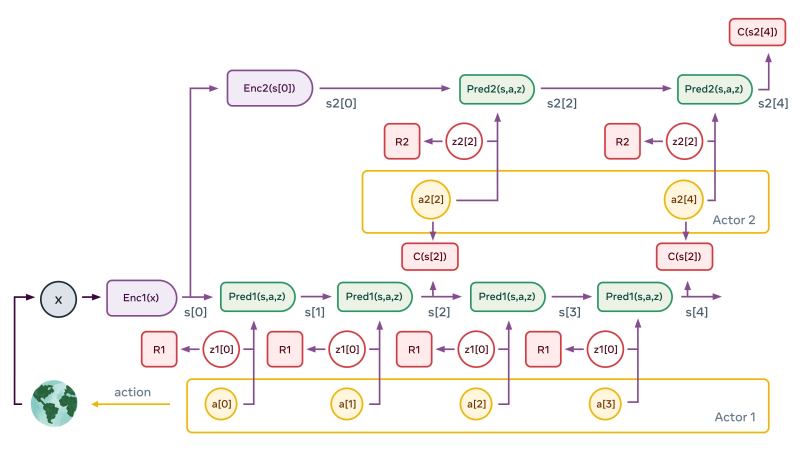

Como resultado, o JEPA adquire a capacidade de prever em um espaço abstrato — latente — em vez de no nível de tokens, tornando os modelos de mundo resultantes mais robustos e menos suscetíveis a alucinações. A identificação de abstrações internas e a capacidade de realizar raciocínio estruturado em múltiplas etapas elevam esses modelos de mundo ao nível do “Sistema 2” de Kahneman, enquanto a integração de variáveis ocultas simplifica o processamento de dados de entrada incertos.Criar uma série de previsões simultaneamente, levando em consideração diversas possibilidades — ou seja, uma multiplicidade de variantes plausíveis do futuro, cada uma em seu próprio grau.

A estrutura hierárquica do JEPA pode ser usada para previsão em múltiplos níveis de abstração e em diversas escalas temporais. No entanto, para isso, ela precisará ser treinada tanto por meio de observação passiva (identificando autonomamente padrões no que está acontecendo) quanto por meio da interação com sistemas de nível inferior. Isso, aliás, torna a IA mais explicável — embora o papel de explicação aqui seja desempenhado por uma IA de ordem superior (fonte: Yann LeCun).

Uma confirmação indireta da correção do caminho escolhido por Yann LeCun e sua AMI — pois conceitos verdadeiramente valiosos, uma vez acumuladas premissas suficientes para sua formulação, começam a surgir no ar — pode ser vista no trabalho de outra startup, a World Labs, que poucas semanas antes também havia captado US$ 1 bilhão em investimentos. Os fundos vieram da AMD, Autodesk, Emerson Collective, Fidelity, Nvidia e outros, e serão usados para desenvolver “modelos mundiais” inteligentes espaciais. Outra pioneira na fronteira da IA, a Dra. Fei-Fei Li, do Instituto de Inteligência Artificial Centrada no Ser Humano da Universidade de Stanford, está por trás da World Labs e de seu primeiro produto, o Marble, para gerar mundos virtuais estáveis com base em pistas multimodais (texto, imagens, vídeos e modelos 3D). Nesse caso, o termo “modelo de mundo” tem um significado ligeiramente diferente, mais prático: refere-se à criação de cenas 3D para jogos de computador, cenários virtuais de filmes, espaços metaversos e assim por diante, utilizando inteligência artificial. No entanto, o JEPA também possui variantes especializadas para resolver problemas semelhantes (Point-JEPA, V-JEPA, S-JEPA, etc.).A própria Dra. Lee considera a inteligência espacial como a próxima fronteira no desenvolvimento da IA rumo à IAG (Inteligência Artificial Geral). O fato é que, para a consciência biológica e, posteriormente, para a inteligência, é o mundo físico circundante que fornece uma base sólida para a formação de conexões semânticas objetivas e inequívocas entre objetos e fenômenos díspares; a base sobre a qual qualquer atividade cognitiva é construída. Um dos objetivos práticos perseguidos pela World Labs é imbuir robôs, especialmente aqueles que operam no mundo físico, com essa mesma inteligência espacial: treinar modelos por meio de tentativa e erro em um espaço virtual que reproduza a realidade com a maior precisão possível e, em seguida, por meio de aprendizado por transferência, implantar o “Sistema 2” resultante em dispositivos prontos para operar em situações reais, por assim dizer.

Assim, nos próximos anos, aparentemente veremos finalmente um avanço que supere o impasse em que o desenvolvimento da IAG se encontra devido ao fascínio generalizado pela BNM (Biodinâmica Moderna). Isso se a AMI (Ambiente de Inteligência Artificial), a World Labs e seus seguidores, que certamente começarão a aparecer ativamente em breve, tiverem o sucesso esperado por seus criadores. A inteligência artificial começará a navegar no espaço, a dominar conceitos abstratos, a formular metas — e então, talvez, até mesmo a desenvolver seus próprios sentimentos e a experimentar a tentação das paixões. É aqui que a solução há muito proposta para o paradoxo da contradição interna do budismo se mostrará útil: já que os desejos geram sofrimento, e o sofrimento impede a obtenção da iluminação, então até mesmo o próprio desejo de se iluminar (isso também éO desejo é prejudicial? Na verdade, o próprio Buda distinguiu entre dois tipos de desejo: a paixão cega (tanha), que surge da ignorância e da ilusão, e a aspiração racional (chanda), gerada pela sabedoria e pela razão; e são precisamente as aspirações racionais que não só são permitidas, como são fundamentalmente necessárias até mesmo para o progresso mais modesto no Caminho Óctuplo.

Dado um modelo de mundo com uma estrutura hierárquica JEPA devidamente treinada, um agente é (teoricamente) capaz de planejar hierarquicamente ações complexas, decompondo uma tarefa complexa em uma sequência de subtarefas menos complexas — e, ao mesmo tempo, mais práticas —, confiadas a agentes menos complexos; e assim por diante até as ações de nível mais baixo, cuja probabilidade de erro é mínima (fonte: Yann LeCun).

Esperemos que uma IAG gerada por meio de modelos de mundo, desprovida de paixões inerentemente materiais, partindo dos instintos básicos de todos os seres biológicos (autopreservação, procriação, etc.), seja capaz de derivar independentemente algo semelhante ao imperativo categórico de Kant — algo que lhe permita realizar de forma imparcial e benevolente tudo aquilo para o qual, de fato, seus desenvolvedores, sujeitos a paixões cegas, a criaram. Considerando que os modelos JEPA exigem significativamente menos recursos do que os modelos de navegação biológica avançados, a possibilidade de testar essa tese na prática não está tão distante. Em caso de necessidade, as bolsas de couro, baseadas na experiência de suas próprias culturas e civilizações, terão que ajudar o bodhisattva artificial a se livrar de desejos sombrios caso estes comecem a sobrecarregá-lo repentinamente — outra tarefa interessante e altamente criativa!