Executar grandes modelos de linguagem de IA localmente em um PC é uma tarefa que está se tornando cada vez mais popular. Para resolver isso, a AMD lançou o Gaia, um programa de código aberto projetado para executar modelos de IA locais em computadores Windows.

Fonte da imagem: amd.com

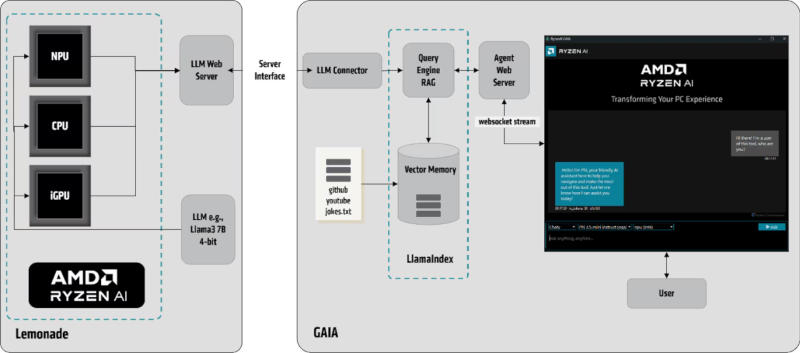

A Gaia oferece otimizações de desempenho adicionais para máquinas com processadores Ryzen AI; A inferência de IA é realizada usando o Lemonade SDK. O programa permite que os modelos sejam adaptados para diversas finalidades: eles podem compilar resumos de textos grandes ou processar problemas complexos que exigem habilidades de raciocínio. O Gaia funciona por meio de um componente de Recuperação-Geração Aumentada (RAG) que combina IA com uma base de conhecimento para fornecer ao usuário respostas mais precisas a consultas com base no contexto.

O RAG inclui quatro agentes:

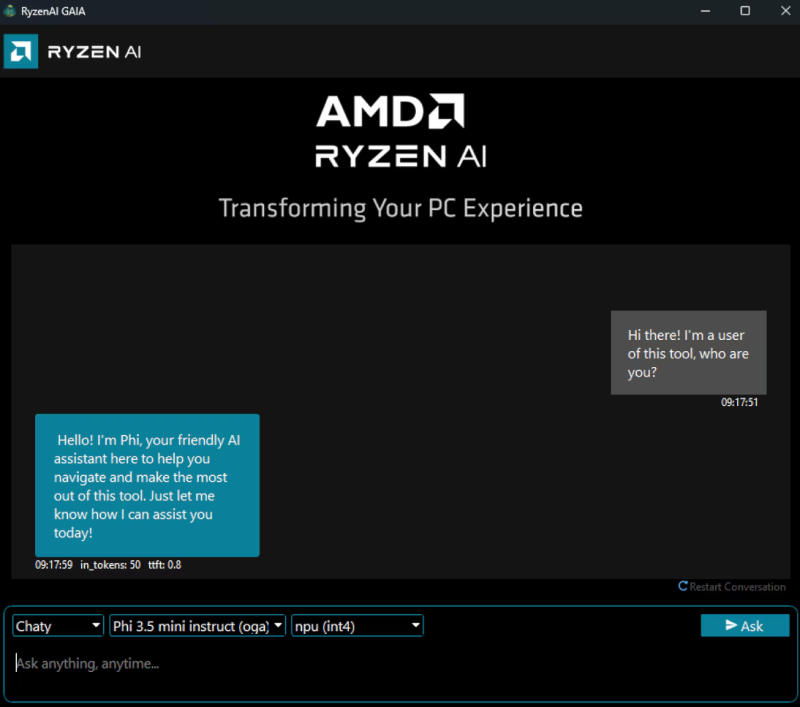

- Conclusão Simples e Rápida – fornece interação direta com o modelo, destinada a testes e avaliação.

- Chaty — responsável pela interface do chatbot.

- Clipe – Pesquisa no YouTube com funcionalidade de perguntas e respostas.

- Joker – gera piadas e adiciona personalidade ao chatbot.

Gaia resolve problemas especializados de IA usando o Lemonade SDK, executado em vários tempos de execução. O Lemonade expõe um serviço web para o modelo de linguagem e interage com o aplicativo Gaia por meio de uma API REST compatível com OpenAI. O aplicativo atua como um agente de IA que extrai e processa dados, “vetoriza” conteúdo externo (como dados do GitHub, YouTube e arquivos de texto) e os armazena em um índice vetorial local. Simplificando, o Gaia melhora as consultas dos usuários antes que elas sejam processadas pelo modelo de IA, aumentando a precisão e a relevância das respostas.

Um instalador híbrido otimizado para sistemas baseados em processadores Ryzen que permite que o Gaia use a Unidade de Processamento Neural (NPU) e os gráficos integrados do Ryzen AI para computação. Executar modelos de IA localmente tem uma série de vantagens em relação aos serviços de nuvem: os dados permanecem seguros, a latência é reduzida e, em alguns casos, o desempenho é melhorado. Além disso, os modelos locais não exigem conexão com a internet.