A empresa chinesa Intellifusion anunciou o lançamento das caixas DeepEyes AI, produzidas usando uma tecnologia de processo de 14 nm e custando apenas 1.000 yuans (US$ 140). Projetado para o espaço de inteligência artificial (IA), este dispositivo promete reduzir o custo do hardware de IA em até 90% em comparação com unidades de processamento gráfico (GPUs) tradicionais.

Fonte da imagem: zhidx.com

Em resposta às sanções impostas pelo governo dos EUA contra a indústria chinesa de IA, a Intellifusion anunciou o lançamento de uma nova caixa de IA chamada DeepEyes. Este dispositivo, criado com tecnologia de processo de 14 nm e supostamente incorporando tecnologia ASIC, garante desempenho de 48 TOPS a um custo de cerca de 1.000 yuans.

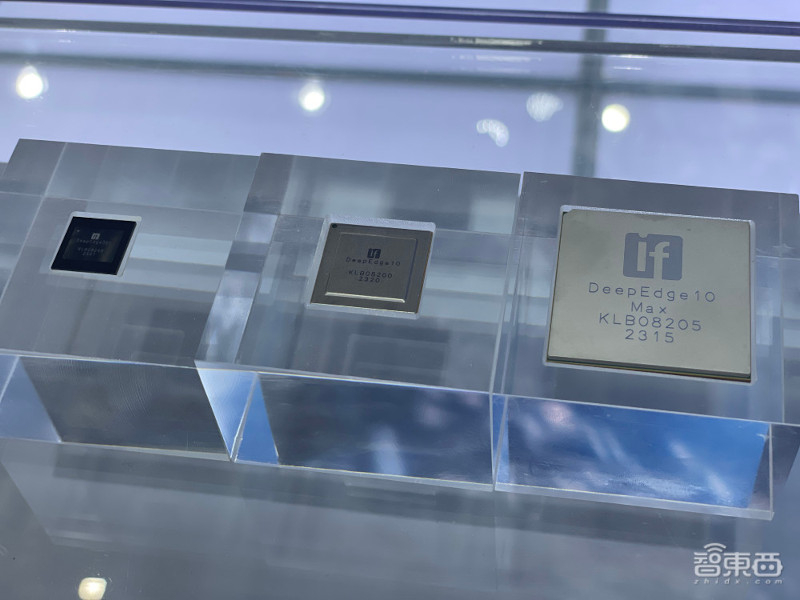

O primeiro modelo DeepEyes, com lançamento previsto para o primeiro semestre de 2024, integrará o sistema DeepEdge10Max em chip (SoC), o que lhe permitirá atingir desempenho de 48 TOPS (INT8). Dando continuidade ao desenvolvimento da linha, o modelo, com lançamento previsto para o segundo semestre do mesmo ano, será equipado com o SoC DeepEdge10Pro, oferecendo desempenho de até 24 TOPS. Os planos da empresa para o primeiro semestre de 2025 incluem a implementação de um aumento significativo de desempenho através da implementação do SoC DeepEdge10Ultra com desempenho máximo de até 96 TOPS. Ao mesmo tempo, a estratégia de preços e a possibilidade de manter os preços dentro de 1.000 yuans continuam a ser objeto de mais discussão e esclarecimento.

O núcleo da arquitetura DeepEyes é o inovador chip de rede neural NNP400T desenvolvido pela Intellifusion. Este chip combina uma poderosa CPU RISC de 1,8 GHz com configuração de 2+8 núcleos e uma GPU com frequência máxima de até 800 MHz, introduzida no modelo DeepEdge10. O elemento-chave do sistema é um processador de rede neural (NPU) altamente eficiente, que melhora significativamente o desempenho geral do dispositivo. Considerando que é necessário um mínimo de 40 TOPS de desempenho de NPU para atender aos requisitos de AI PC da Microsoft, os desenvolvimentos do Intellifusion parecem bastante promissores. A comparação com os números atuais de NPU, atingindo apenas 16 TOPS, destaca o potencial do novo produto chinês. Além disso, espera-se que os próximos chips Snapdragon com desempenho de 40 TOPS estabeleçam novos padrões na indústria.

Chen Ning, presidente da Intellifusion, prevê que a parcela de empresas que implementam ativamente modelos de IA em grandes linguagens em suas operações chegará a 80% nos próximos três anos. Neste contexto, os custos significativos de desenvolvimento e formação de modelos avançados de IA, que podem atingir dezenas de milhões de dólares, bem como o custo de aquisição de equipamento especializado, tornam-se uma séria barreira para a maioria das empresas. As tecnologias oferecidas pela Intellifusion resolvem esse problema, fornecendo soluções altamente eficientes e econômicas para treinamento e integração de grandes modelos de linguagem de IA.