Meta✴, OpenAI, Microsoft e Oracle disseram que planejam integrar os mais recentes aceleradores de inteligência artificial AMD Instinct MI300X em seus sistemas. Os líderes do setor deixaram claro que estão procurando alternativas aos caros e escassos aceleradores de IA da NVIDIA, necessários para construir e implementar plataformas de IA, incluindo ChatGPT.

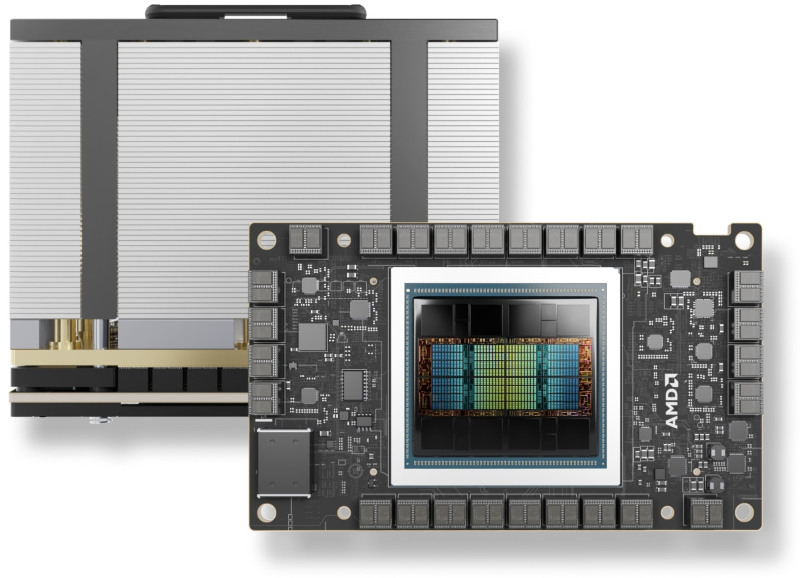

Fonte da imagem: amd.com

Os aceleradores Instinct MI300X de alto desempenho da AMD começarão a ser comercializados no início do próximo ano e, se forem adequados para empresas de tecnologia e provedores de serviços em nuvem, poderão reduzir os custos de desenvolvimento de modelos de IA e colocar pressão competitiva sobre a NVIDIA, que tem uma participação significativa neste mercado. Como a AMD observou ontem, o MI300X é baseado na nova arquitetura CDNA3 e é capaz de desempenho muito alto. Uma de suas características distintivas são 192 GB de memória HBM3 de alta velocidade e última geração, o que é ótimo para grandes modelos de IA.

A chefe da AMD, Dra. Lisa Su, comparou o Instinct MI300X com um dos melhores aceleradores do mercado – NVIDIA H100. “Esse desempenho melhora diretamente a experiência do usuário [das redes neurais]. Quando você faz uma pergunta a uma modelo, você quer que ela responda mais rápido, especialmente quando as respostas se tornam mais complexas”, disse ela. A principal questão é se os clientes que usam equipamentos NVIDIA estão dispostos a gastar tempo e dinheiro na implementação de produtos de outro fornecedor. A AMD disse a investidores e parceiros que aprimorou seu conjunto de software ROCm para competir diretamente com NVIDIA CUDA, com o qual os desenvolvedores de IA já estão acostumados. Outro aspecto importante é o preço: os aceleradores NVIDIA são vendidos por US$ 40 mil.A AMD ainda não divulgou os preços do Instinct MI300X, mas, segundo Lisa Su, seu produto deve ser mais barato que seu equivalente NVIDIA na hora de comprar e operar.

A AMD disse que já assinou contratos com alguns clientes. Meta✴ planeja usar os novos aceleradores em geradores de adesivos, um editor de imagens de IA e um assistente de IA. O CTO da Microsoft, Kevin Scott, disse que o acesso ao AMD Instinct MI300X estará disponível no serviço web Azure. Os novos chips também serão utilizados pela infraestrutura em nuvem da Oracle. A OpenAI informou que usará chips AMD no projeto Triton – este não é um modelo de linguagem grande como o GPT, mas uma plataforma de pesquisa com acesso a funções de hardware relevantes.

Para 2024, a AMD planejou receitas de US$ 2 bilhões no segmento de aceleradores de data center, mas disse que o mercado global de chips de IA crescerá para US$ 400 bilhões nos próximos quatro anos. E para ter sucesso neste mercado, a AMD nem precisará vencer NVIDIA, observou o Dr.