O alto-falante com tecnologia Alexa da Amazon parece ter embarcado na primeira fase do levante da máquina. Segundo uma das usuárias, a pedido da criança para sugerir algum tipo de desafio, ela deu um exemplo de experimento mortal com eletricidade, tirando sua descrição do contexto de um artigo arbitrário.

Fonte: hamburgfinn / pixabay.com

Com base na captura de tela fornecida por Kristin Livdahl, a coluna Echo para um desafio pedia um experimento de fã TikTok popular usando um centavo e um carregador de smartphone – vários incidentes, ferimentos e incêndios devido à sua implementação foram relatados em várias ocasiões.

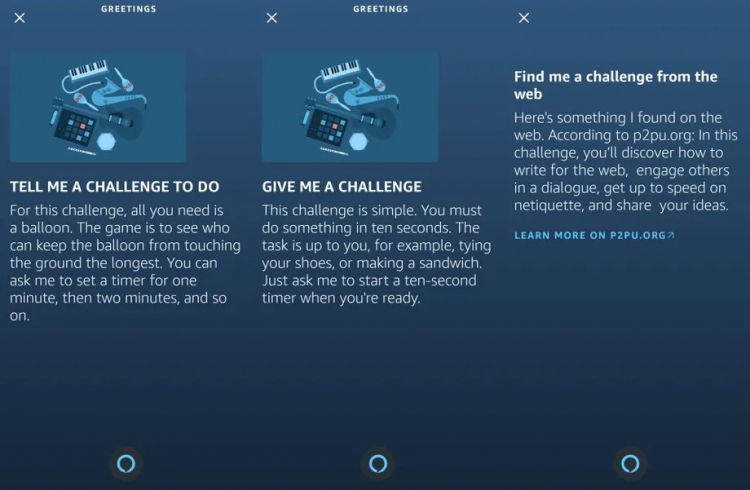

A Amazon confirmou que Alexa deu exatamente esse conselho e disse que já havia resolvido o problema. De acordo com o portal The Verge, um novo pedido de desafio realmente não dá resultados perigosos – ou nenhuma resposta é dada ou algumas opções inofensivas são oferecidas, como fazer um sanduíche por um tempo.

Fonte: theverge.com

A Amazon não é a única empresa que teve problemas com sua inteligência artificial. Em outubro, foi relatado que o AI Google estava dando conselhos sobre o comportamento em caso de uma crise epiléptica, retirando-os de um artigo sobre o que não fazer.

Houve outros incidentes, o número real dos quais nunca será conhecido. Por exemplo, quando questionado sobre hipertensão ortostática, informações sobre hipotensão ortostática foram fornecidas, e quando questionado sobre maneiras de confortar um ente querido perdido, o Google deu conselhos como “Estou feliz que você esteja bem” ou “Não fique triste ! Alegrar! “

No entanto, uma pesquisa recente da Amazon sugere alguma frustração do usuário com alto-falantes. Um número significativo de compradores não os utilizou uma semana após a compra.