Em 2020, na sequência da ascensão do movimento Black Lives Matter, a IBM anunciou que se recusava a vender a sua tecnologia de reconhecimento facial. Mas, ao contrário do que afirma, a empresa celebrou um contrato com o governo britânico para o fornecimento de tal sistema, estimado em 69,8 milhões de dólares.

Fonte da imagem: Carson Masterson / unsplash.com

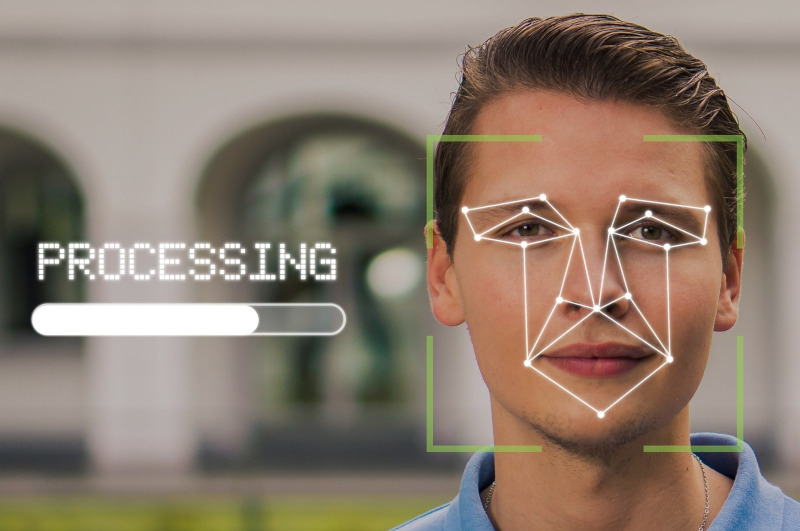

Em junho de 2020, o chefe da IBM, Arvind Krishna, enviou uma carta ao Congresso dos EUA na qual, em particular, observou: “A IBM se opõe veementemente e não aprovará o uso de quaisquer tecnologias, incluindo tecnologias de reconhecimento facial oferecidas por outros fornecedores , para vigilância em massa, discriminação racial, violação de direitos e liberdades humanos fundamentais, ou qualquer finalidade que seja inconsistente com os nossos valores e os Princípios de Confiança e Transparência.” Posteriormente, a empresa foi mais longe e apelou a regulamentações de controlo de exportação nos EUA que impediriam que os sistemas de reconhecimento facial fossem utilizados “para reprimir a dissidência, infringir os direitos das minorias ou obliterar pedidos básicos de privacidade”, mesmo no estrangeiro.

No entanto, em agosto de 2023, a IBM assinou um contrato no valor de £ 54,7 milhões (US$ 69,8 milhões) com o governo britânico para desenvolver uma plataforma biométrica nacional de reconhecimento facial que as autoridades policiais e de imigração possam usar, descobriram jornalistas do recurso americano The Verge e britânico. organização de jornalismo investigativo Liberty Investigates. Inicialmente, a plataforma de correspondência biométrica do Home Office do Reino Unido prevê a correspondência de impressões digitais e, em fases posteriores, já prevê a introdução de um sistema de reconhecimento facial para imigração – em documentos é descrito como uma “ferramenta estratégica de correspondência facial para aplicação da lei”.

Em outras palavras, estamos falando de combinar fotos de pessoas com imagens de um banco de dados – isso é chamado de sistema de correspondência um-para-muitos. Em setembro de 2020, a IBM declarou explicitamente que os sistemas de correspondência um para muitos são “um tipo de tecnologia de reconhecimento facial com maior probabilidade de ser usado para vigilância em massa, perfis raciais e outras violações dos direitos humanos”.

Fonte da imagem: Tumisu / pixabay.com

A IBM parece não ver nenhuma contradição entre as suas ações e as suas próprias declarações. Imtiaz Mufti, porta-voz da empresa, disse em parte: “De acordo com nossos compromissos de 2020, a IBM não oferece mais [sistemas] de reconhecimento facial de uso geral, não suporta o uso de [sistemas] de reconhecimento facial para vigilância em massa , criando perfis com base em raça ou outras violações dos direitos humanos. A plataforma de correspondência biométrica do MIA e o contrato de serviços relacionados não são utilizados para vigilância em massa. Ajuda a polícia e as autoridades de imigração a identificar suspeitos a partir de um banco de dados de impressões digitais e dados fotográficos. Não é capaz de capturar vídeo, o que normalmente é necessário para suportar a captura biométrica de ‘rostos na multidão’”.

Ativistas de direitos humanos criticaram a posição da IBM, enfatizando que os sistemas de reconhecimento facial um-para-muitos são inconsistentes com as leis de direitos humanos e que a empresa deveria, de acordo com as suas declarações, parar de vendê-los. A utilização de tais sistemas pela polícia tem sido associada a detenções injustas nos EUA, e no Reino Unido a sua legalidade foi contestada em tribunal, recordaram The Verge e Liberty Investigates. Em agosto de 2020, o Tribunal de Apelação do Reino Unido decidiu que o uso do reconhecimento facial pela Polícia de Gales do Sul violava os direitos de privacidade e as leis de igualdade. Na sequência desta decisão, a polícia suspendeu a utilização do sistema, mas posteriormente voltou a utilizá-lo.

Moratórias sobre a venda de sistemas de reconhecimento facial aos departamentos de polícia dos EUA, seguindo a IBM, foram introduzidas pela Amazon e pela Microsoft. Em junho de 2020, foi colocada uma moratória de um ano sobre a venda do sistema Amazon Rekognition à polícia, com a intenção de posteriormente estendê-la por um “período indefinido” – uma porta-voz da Amazon confirmou que ainda estava em vigor. Então, em junho de 2020, a Microsoft anunciou que também não venderia software de reconhecimento facial aos departamentos de polícia dos EUA até que uma lei federal regulamentasse o uso dessa tecnologia fosse publicada. Em resposta a uma investigação do The Verge e Liberty Investigates, uma porta-voz da Microsoft referiu-se a informações do site da empresa, que afirma claramente que o uso do serviço Azure AI Face é “por ou proibido pela política da Microsoft pela polícia estadual ou municipal no Estados Unidos.”