De acordo com estimativas da empresa analítica Tech Insights, citada pela HPC Wire, a NVIDIA vendeu aproximadamente 3,76 milhões de aceleradores GPU orientados para data centers em 2023. Isso é mais de 1 milhão de unidades superior ao resultado de 2022, quando as entregas desses produtos foram estimadas em 2,64 milhões de unidades.

Considerando as soluções da AMD e da Intel, o fornecimento total de aceleradores GPU para data centers em 2023 foi de 3,85 milhões de unidades contra aproximadamente 2,67 milhões de unidades em 2022. É verdade que uma parcela tão pequena das remessas de soluções AMD e Intel levanta algumas dúvidas. Como observa James Sanders, analista da Tech Insights, atualmente não há recursos de hardware suficientes no mercado para atender a todas as necessidades de IA. E, portanto, a demanda por aceleradores e chips especializados por parte de desenvolvedores que competem com a NVIDIA crescerá.

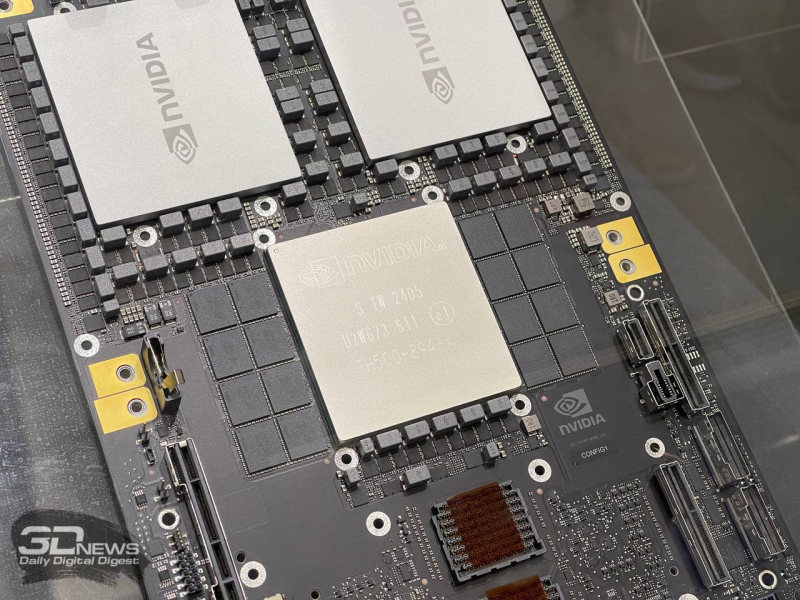

De acordo com estimativas da TechInsights, no final de 2023, a NVIDIA controlava cerca de 98% do mercado global de aceleradores baseados em GPU para data centers. A empresa demonstrou resultado semelhante um ano antes. Este crescimento está associado ao rápido desenvolvimento de aplicações de IA e ao aumento da procura por sistemas HPC. Ao mesmo tempo, a NVIDIA é responsável por 98% da receita da venda desses aceleradores: em 2023 eles renderam à empresa US$ 36,2 bilhões, o que é mais de três vezes maior do que o valor do ano passado de US$ 10,9 bilhões.

De acordo com a TechInsights, em 2023, a AMD enviou cerca de 50 mil aceleradores para data centers, e a Intel – cerca de 40 mil unidades (o material HPCWire original indicava valores ordens de grandeza superiores; ajustes feitos de acordo com os 2% de participação de mercado restantes). Em 2024, acreditam os especialistas, a procura por tais produtos à escala global aumentará. Estamos falando, em particular, dos aceleradores da série Instinct MI300 desenvolvidos pela AMD. Ao mesmo tempo, a AMD afirma que pretende lançar novas soluções anualmente: o acelerador MI325X está previsto para 2024, o MI350 para 2025 e o MI400 para 2026. Por sua vez, a Intel promove os produtos Gaudi3.

Os principais hiperscaladores também estão projetando chips de IA especializados. Assim, a AWS introduziu no final do ano passado o acelerador Trainium2 AI, projetado para treinar redes neurais. O Google anunciou os produtos Cloud TPU v5p e a Microsoft anunciou o Maia 100. A Meta✴ pretende implementar ativamente seus próprios aceleradores Artemis AI.