Na primavera passada, a Anthropic anunciou a sua intenção de criar um “algoritmo de IA de autoaprendizagem de próxima geração” que pudesse realizar a maioria das tarefas de escritório por conta própria, permitindo-lhe automatizar grandes partes da economia. A empresa lançou hoje a versão 3.5 de seu modelo Claude Sonnet, que pode interagir com qualquer aplicativo de desktop por meio da API Computer Use, simulando pressionamentos de teclas, cliques e gestos do mouse, emulando completamente uma pessoa.

Fonte da imagem: Pixabay

«Treinamos Claude para ver o que estava acontecendo na tela e depois usar as ferramentas de software disponíveis para concluir as tarefas”, diz Anthropic. “Quando um desenvolvedor designa Claude para usar um software de computador e lhe dá o acesso necessário, Claude olha as capturas de tela do que o usuário vê e calcula quantos pixels vertical ou horizontalmente ele precisa para mover o cursor para clicar no lugar certo .”

Uma ferramenta como essa, chamada de “agente de IA” que pode automatizar tarefas em um PC, não é uma ideia nova. O termo agente de IA permanece vagamente definido, mas geralmente se refere à IA que pode automatizar o trabalho com software em um PC. Muitas empresas oferecem ferramentas semelhantes hoje, desde Microsoft, Salesforce e OpenAI até novos players como Relay, Induced AI e Automat.

A startup de gadgets para o consumidor, Rabbit, lançou um agente que pode comprar ingressos on-line de forma independente. Adept, recentemente adquirida pela Amazon, treina modelos para navegar em sites e softwares. Twin Labs usa modelos prontos para uso, incluindo GPT-4o da OpenAI, para automatizar processos de desktop.

Alguns analistas acreditam que os agentes de IA poderiam fornecer uma maneira mais fácil para as empresas monetizarem os bilhões de dólares que investem em IA. De acordo com uma pesquisa recente da Capgemini, 10% das organizações já utilizam agentes de IA e 82% planeiam integrá-los nos próximos três anos.

Fonte da imagem: unsplash.com

A Anthropic chama seu conceito de agente de IA de “camada de execução de ação” que permite executar comandos no nível do desktop. Graças à capacidade de navegar na web, Claude 3.5 Sonnet pode usar qualquer site e qualquer aplicativo.

«As pessoas controlam o processo com instruções que direcionam as ações de Claude, como “usar dados do meu computador e da rede para preencher este formulário”, explica um porta-voz da Anthropic. — As pessoas permitem o acesso e limitam-no conforme necessário. Claude divide os prompts do usuário em comandos de computador (por exemplo, mover o cursor, clicar, digitar) para executar aquela tarefa específica.”

Fonte da imagem: Antrópico

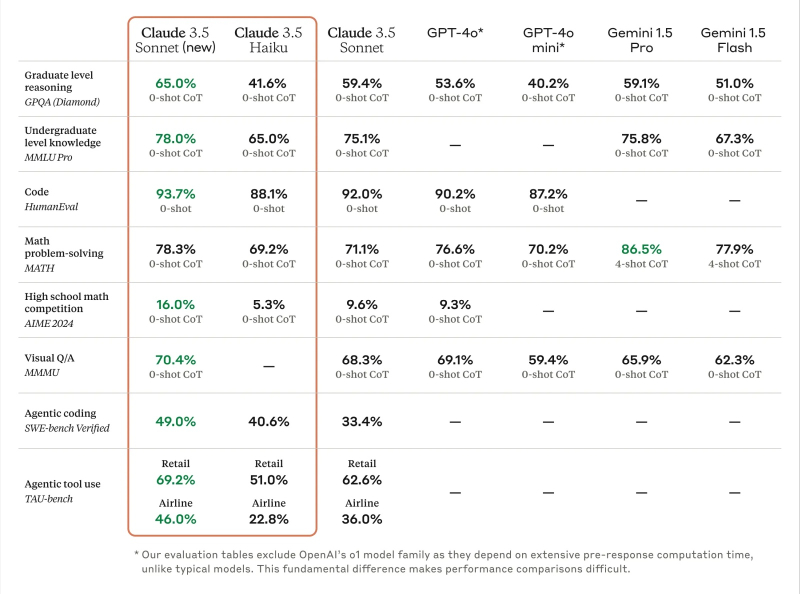

Qual a diferença entre o Claude 3.5 Sonnet e outros agentes de IA? A Anthropic afirma que é simplesmente um modelo mais forte e confiável que lida com tarefas de codificação melhor do que o carro-chefe da OpenAI, o1, de acordo com o benchmark SWE-bench Verified. Claude ajusta e repete tarefas de forma independente quando enfrenta obstáculos e pode trabalhar em metas que exigem dezenas ou centenas de passos.

Dito isso, a Anthropic reconhece que o modelo atualizado tem dificuldade com ações básicas como rolagem e zoom, e pode perder eventos e notificações de curta duração devido à forma como captura capturas de tela e as une. Durante um teste de reserva de voo, Claude 3.5 Sonnet conseguiu completar com sucesso menos da metade das tarefas. Na tarefa de devolução de passagens, o novo modelo falhou em cerca de um terço dos casos.

Resultados de testes comparativos de modelos de IA da Anthropic

Do lado da segurança, um estudo recente descobriu que mesmo modelos sem a capacidade de usar aplicativos de desktop, como o GPT-4o da OpenAI, podem se envolver em um “comportamento de agente em várias etapas” malicioso, como solicitar um passaporte falso na dark web. Resultados semelhantes foram alcançados por pesquisadores que utilizaram técnicas de jailbreak, o que resultou em uma alta porcentagem de tarefas maliciosas bem-sucedidas, mesmo para modelos protegidos.

É concebível que um modelo com acesso controlado por PC possa causar danos significativamente maiores – por exemplo, explorando vulnerabilidades de aplicativos para comprometer informações pessoais (ou salvar bate-papos em texto simples). Além das alavancas de software à sua disposição, as conexões de rede e aplicativos do modelo podem abrir amplas oportunidades para invasores.

A Anthropic não nega que o uso do Claude 3.5 Sonnet expõe o usuário a riscos adicionais. Mas, de acordo com a empresa, “é muito melhor dar acesso aos computadores aos modelos mais limitados e relativamente seguros de hoje – para que possamos começar a observar e aprender com quaisquer problemas potenciais que surjam neste nível inferior, aumentando gradual e simultaneamente o uso do computador”. e medidas de mitigação.” riscos de segurança.”

A Anthropic afirma que tomou algumas medidas para evitar o uso inadequado, como não treinar um novo modelo com base em capturas de tela e solicitações do usuário e não permitir que o modelo fique online durante o treinamento. A empresa desenvolveu classificadores para prevenir atividades de alto risco, como postagens em redes sociais, criação de contas e interação com recursos governamentais.

A Antthropic disse que tem a capacidade de restringir o acesso a recursos adicionais “se necessário”, como proteção contra spam, fraude e desinformação. Por precaução, a empresa armazena todas as capturas de tela feitas pelo Uso do Computador por pelo menos 30 dias, o que pode representar riscos adicionais de segurança e privacidade. A Anthropic não disse em que circunstâncias poderá compartilhar capturas de tela com terceiros (como autoridades policiais).

«Não existe um método infalível e avaliaremos e melhoraremos continuamente nossas medidas de segurança para equilibrar as capacidades de Claude com o uso responsável”, afirma Antrópico. “Aqueles que usam a versão desktop do Claude devem tomar as precauções adequadas para minimizar esses riscos, incluindo isolar Claude de dados altamente confidenciais em seus computadores.”

Fonte da imagem: Pixabay

Junto com o lançamento do modelo Claude 3.5 Sonnet, a Anthropic anunciou o lançamento iminente de uma versão atualizada do Claude 3.5 Haiku. “Com sua alta velocidade, acompanhamento aprimorado e uso mais preciso de ferramentas, o Claude 3.5 Haiku é adequado para produtos voltados ao usuário, tarefas especializadas de subagentes e criação de experiências personalizadas a partir de grandes quantidades de dados, como histórico de compras, preços , ou dados de inventário”, diz o blog Anthropic. O Haiku estará inicialmente disponível como modelo de texto e posteriormente como parte de um pacote multimodal que pode analisar texto e imagens.

Sobre o lançamento do Claude 3.5 Opus atualizado, um porta-voz da Anthropic disse: “Todos os modelos da família Claude 3 têm sua própria aplicação individual para os clientes. Claude 3.5 Opus está em nosso roteiro e com certeza compartilharemos mais detalhes com vocês assim que possível.”

Os desenvolvedores já podem testar o uso do computador por meio da API Anthropic, Amazon Bedrock e da plataforma Vertex AI do Google Cloud.