Segundo estimativas da Bloomberg, os fornecedores asiáticos agora representam aproximadamente 90% dos custos de fabricação da Nvidia, um aumento em relação aos 65% do ano anterior. Esse número inclui a cadeia de suprimentos já estabelecida da Nvidia para componentes de data center: produção de chips na TSMC, memória de alta largura de banda da SK Hynix e Samsung, e montagem de servidores na Foxconn e Quanta. No entanto, a Nvidia está lançando agora categorias inteiramente novas de produtos de IA, fornecidos pelas mesmas empresas.

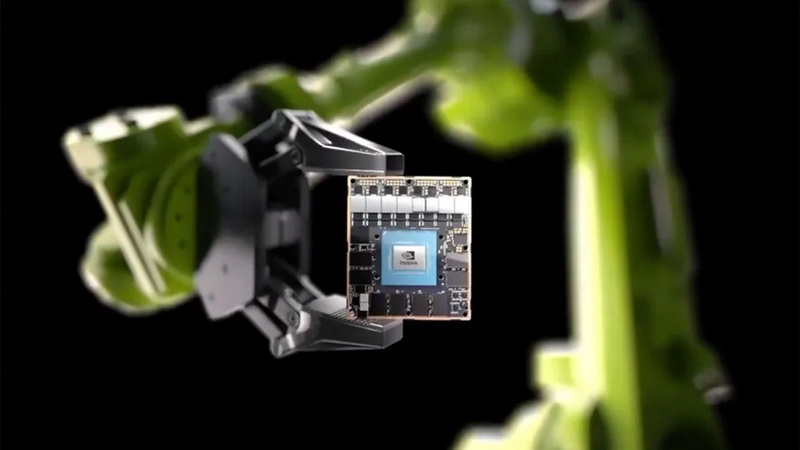

Fonte da imagem: Nvidia

A plataforma de robótica Jetson Thor da Nvidia, lançada em agosto passado, é baseada na arquitetura de GPU Blackwell e fabricada com a tecnologia de processo de 3 nm da TSMC. O modelo principal T5000 oferece 2.070 teraflops de desempenho FP4 e vem equipado com 128 GB de memória LPDDR5X, enquanto o modelo T4000, de custo mais acessível e apresentado na CES 2026, oferece 1.200 teraflops de desempenho FP4 e vem equipado com 64 GB de memória. Seu preço é de US$ 1.999 por unidade. Ambos os modelos utilizam núcleos de CPU Arm Neoverse-V3AE e memória LPDDR5X da Samsung ou da SK hynix. Esses sistemas competem com as GPUs Blackwell pelo acesso ao processo de fabricação de wafers de silício de 3 nm da TSMC para data centers. Os parceiros de fabricação da Nvidia, incluindo a Boston Dynamics e a Amazon Robotics, estão utilizando ativamente essa plataforma, e a LG confirmou que está “explorando a colaboração estratégica com a Nvidia na área de IA física”, inclusive em robótica, segundo a Bloomberg.

O sistema em chip automotivo Drive AGX Thor da Nvidia é outra linha de produtos baseada na arquitetura Blackwell que compete pela mesma capacidade de fabricação de 3 nm. Nenhum desses produtos de IA física requer a avançada tecnologia de encapsulamento CoWoS da TSMC, que continua sendo um grande gargalo na produção de GPUs para data centers. No entanto, sua produção exige wafers de 3 nm e memória LPDDR5X da Ásia, que já estão em falta.A mesma dinâmica do mercado de memória que está impulsionando o surgimento de novos produtos da Nvidia para inteligência artificial física.O avanço da inteligência artificial está levando simultaneamente ao abandono de tecnologias mais antigas. No final de abril, foi anunciado que a Nvidia acelerou o desmantelamento dos módulos Jetson TX2 e Xavier porque o fornecimento de LPDDR4 se tornou muito limitado para sustentar a produção.

A Samsung abandonou a produção de LPDDR4 e a demanda por memória impulsionada pelo desenvolvimento da inteligência artificial redirecionou a produção para produtos mais lucrativos. Isso está forçando os clientes do Jetson a usar módulos Orin ou Thor, que utilizam memória LPDDR5X dos mesmos fornecedores asiáticos, cujas capacidades já estão sobrecarregadas pela demanda por HBM e DRAM para data centers.

De acordo com o chefe da divisão de embalagens de chips da TSMC na América do Norte, a produção de embalagens CoWoS avançadas para GPUs de data centers na TSMC está crescendo a uma taxa média anual de 80%. Enquanto isso, os chips fabricados na fábrica da TSMC no Arizona ainda são enviados para Taiwan para serem embalados.

No ano passado, a Nvidia investiu US$ 500 bilhões na produção de servidores nos EUA em parceria com a Foxconn e a Wistron, bem como com a Amkor e a SPIL, que estão construindo fábricas de gabinetes avançados no Arizona. No entanto, essas instalações ainda não atingiram a capacidade máxima de produção, e suas linhas de produtos de IA estão expandindo sua gama de componentes provenientes da Ásia mais rapidamente do que os fabricantes locais conseguem absorver.