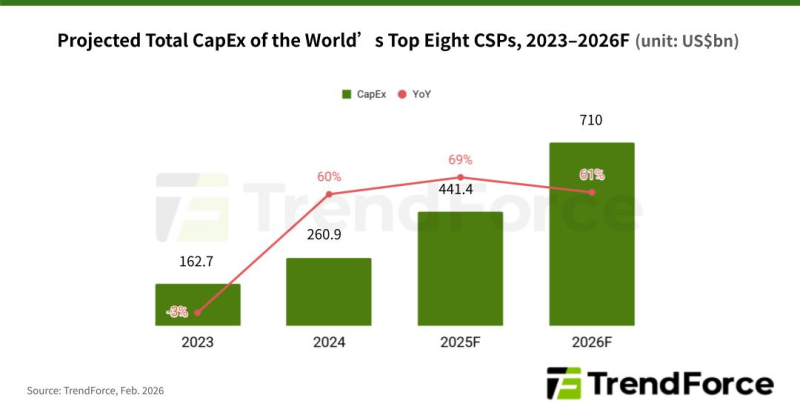

Este ano, a TrendForce estima que os oito maiores provedores de nuvem do mundo — Google, Amazon, Meta✴, Microsoft, Oracle, Tencent, Alibaba e Baidu — investirão mais de US$ 710 bilhões em despesas de capital, um aumento de aproximadamente 61% em relação ao ano passado e superior ao Produto Interno Bruto (PIB) da Irlanda no ano passado. Os quatro maiores hiperescaladores dessa lista respondem por aproximadamente US$ 650 bilhões desse montante, segundo o The Register.

Esses recursos serão destinados à construção e expansão de data centers, bem como à aquisição de equipamentos para eles, incluindo servidores de alto desempenho, geralmente equipados com aceleradores AMD ou NVIDIA. ASICs de outras marcas também estão ganhando popularidade; diferentemente dos aceleradores de uso geral, esses são projetados para cargas de trabalho específicas.

De acordo com a TrendForce, o Google continua sendo a única empresa de nuvem a adicionar mais servidores baseados em ASIC do que em GPUs. Segundo analistas da consultoria, as Unidades de Processamento Tensorial (TPUs) alimentarão aproximadamente 78% dos servidores de data center de IA do Google este ano.

A Amazon deverá ter GPUs equipando 60% de seus servidores e começará a expandir seus sistemas baseados em Trainium3 ainda este ano. A Meta✴ também dependerá principalmente de aceleradores NVIDIA e AMD, que equiparão mais de 80% de seus servidores instalados este ano. A Microsoft continuará adquirindo sistemas de rack da NVIDIA e a Oracle está expandindo sua implantação de servidores de rack com GPUs. Entre as operadoras chinesas, a Tencent também continuará implantando servidores com aceleradores NVIDIA, embora indiretamente.

Fonte da imagem: TrendForce

O The Register observou que a alta demanda por servidores de IA elevou os preços da memória e causou escassez, à medida que os fabricantes direcionam suas linhas de produção para soluções de maior margem de lucro, como a memória HBM. As fabricantes de chips de memória SK Hynix e Sandisk anunciaram que estão trabalhando em um processo de padronização para memória HBF para inferência de IA. A SK Hynix descreve a HBF como um novo nível de memória entre a HBM ultrarrápida e os SSDs de alta capacidade, afirmando que ela reduzirá o custo total de propriedade (TCO) e aumentará a escalabilidade dos sistemas de IA. A empresa prevê que a demanda por soluções como a HBF aumentará por volta de 2030.

Se você encontrar um erro, selecione-o com o mouse e pressione CTRL+ENTER. | Você pode escrever uma versão melhor? Ficaremos felizes em receber seu feedback.

Fonte: